تمت ترجمة هذا المستند بواسطة الذكاء الاصطناعي. للحصول على معلومات دقيقة، يرجى الرجوع إلى النسخة الإنجليزية.

محادثة نصية

موظفو الذكاء الاصطناعيCommunity Edition+مقدمة

باستخدام عقدة LLM في سير العمل، يمكنك بدء محادثة مع خدمة LLM عبر الإنترنت، والاستفادة من قدرات النماذج اللغوية الكبيرة للمساعدة في إنجاز سلسلة من العمليات التجارية.

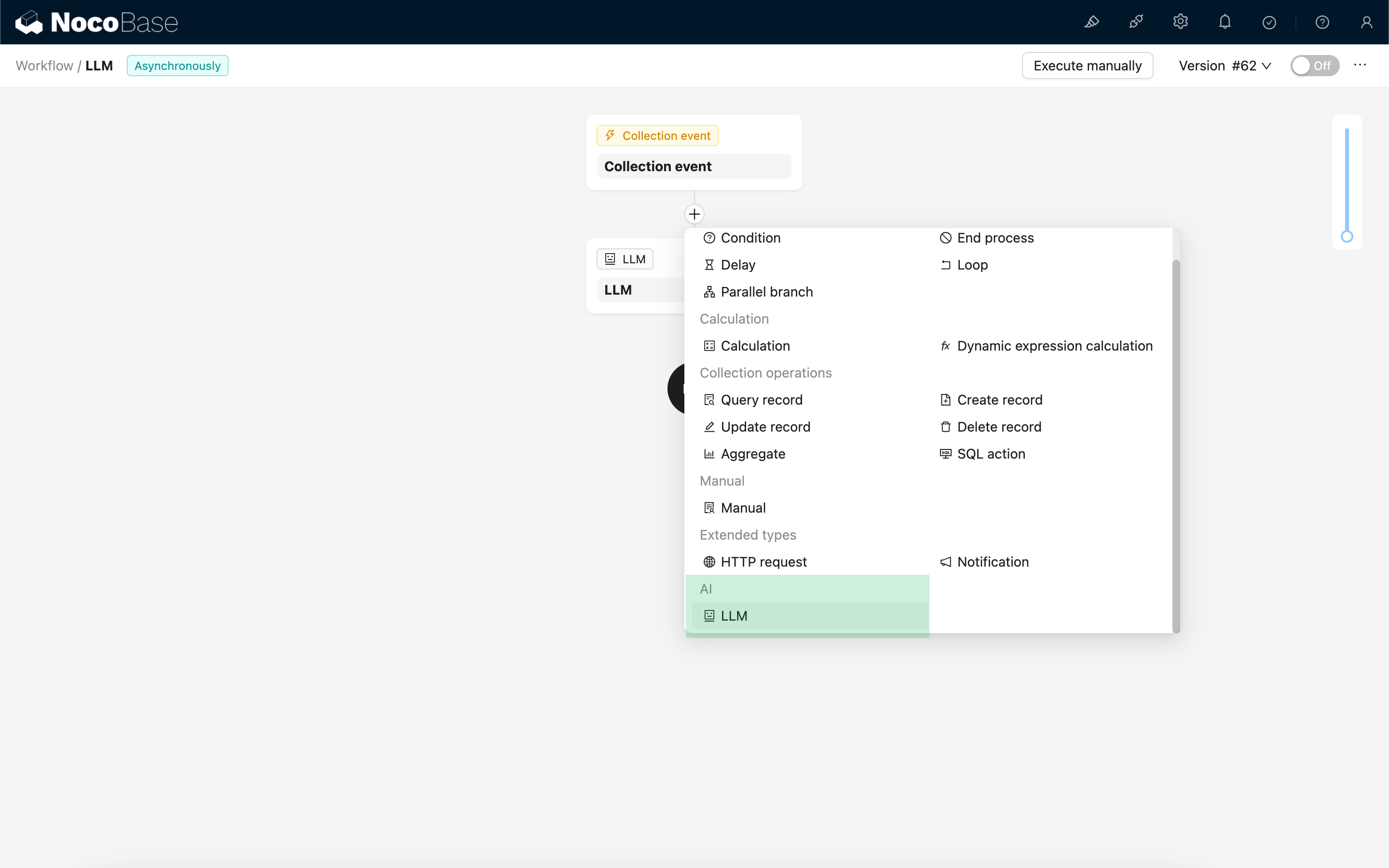

إنشاء عقدة LLM

نظرًا لأن المحادثات مع خدمات LLM تستغرق وقتًا طويلاً غالبًا، لا يمكن استخدام عقدة LLM إلا في سير العمل غير المتزامن.

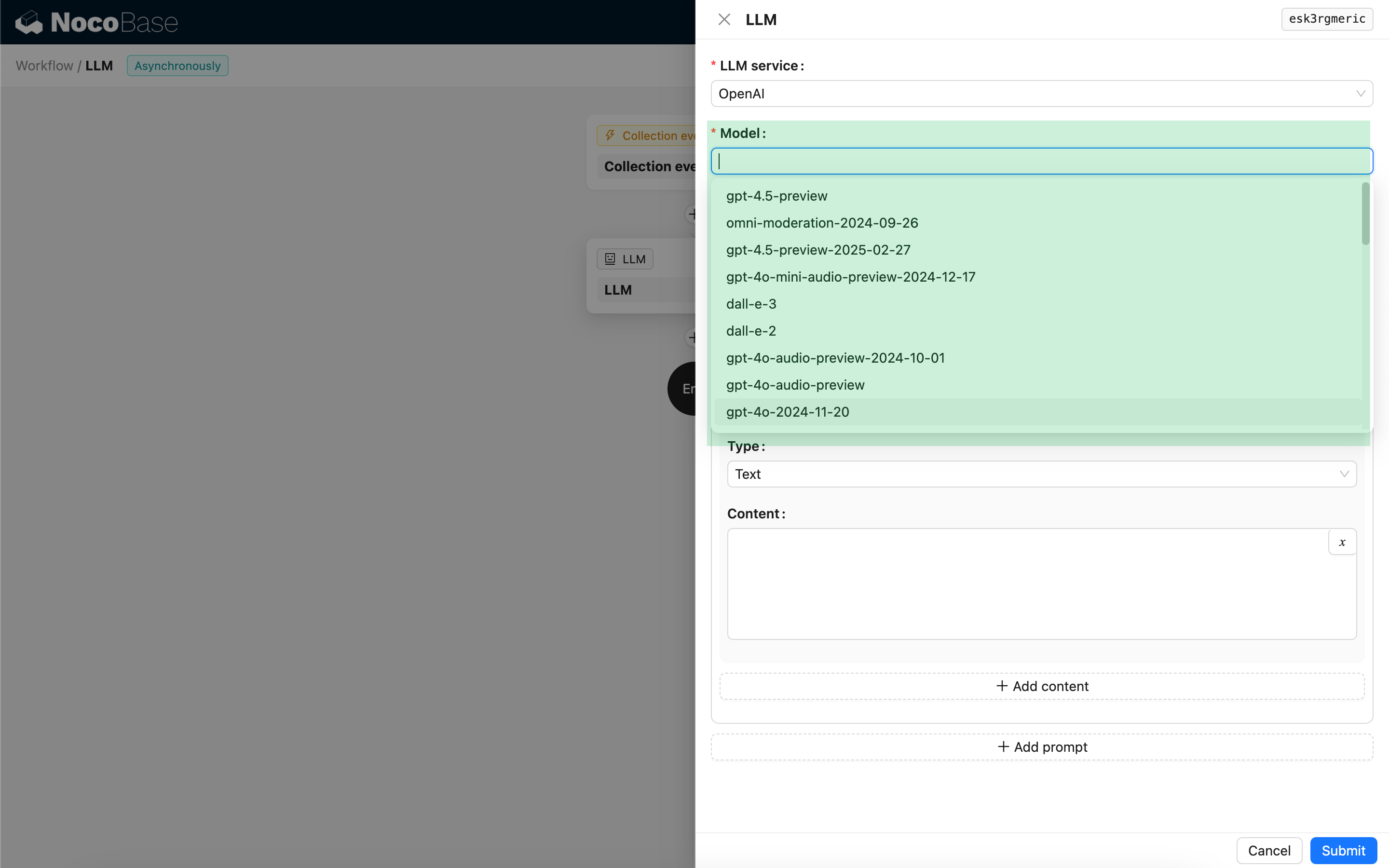

اختيار النموذج

أولاً، اختر خدمة LLM متصلة. إذا لم تكن هناك خدمة LLM متصلة بعد، فستحتاج إلى إضافة إعدادات خدمة LLM أولاً. راجع: إدارة خدمة LLM

بعد اختيار الخدمة، سيحاول التطبيق استرداد قائمة بالنماذج المتاحة من خدمة LLM لتختار منها. قد لا تتوافق واجهات برمجة التطبيقات (APIs) لبعض خدمات LLM عبر الإنترنت التي تستخدم لجلب النماذج مع بروتوكولات API القياسية؛ في هذه الحالات، يمكن للمستخدمين أيضًا إدخال معرف النموذج يدويًا.

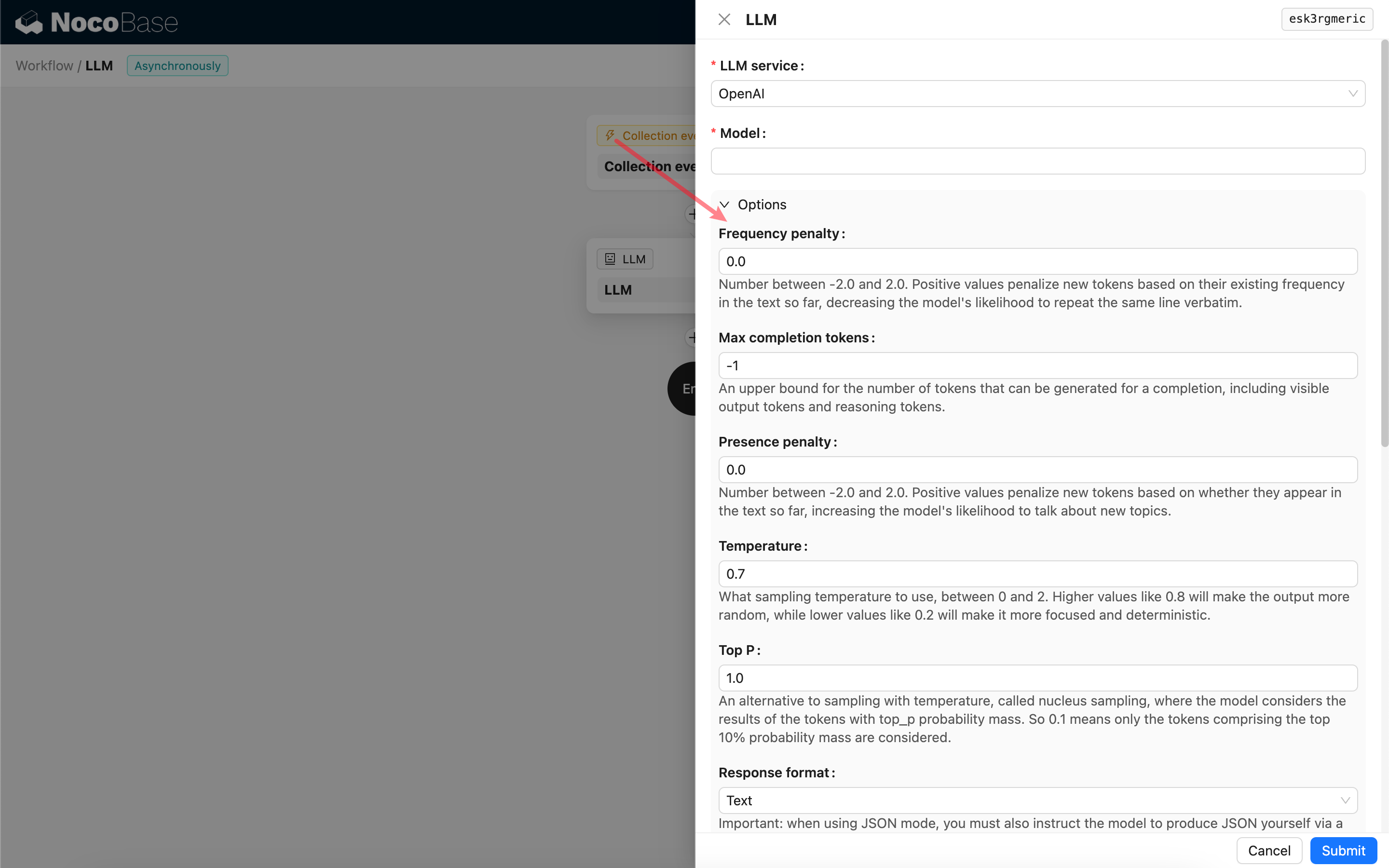

تعيين معلمات الاستدعاء

يمكنك تعديل معلمات استدعاء نموذج LLM حسب الحاجة.

تنسيق الاستجابة

تجدر الإشارة إلى إعداد Response format. يُستخدم هذا الخيار لتوجيه النموذج اللغوي الكبير بشأن تنسيق استجابته، والذي يمكن أن يكون نصًا أو JSON. إذا اخترت وضع JSON، فكن على دراية بما يلي:

- يجب أن يدعم نموذج LLM المقابل الاستدعاء في وضع JSON. بالإضافة إلى ذلك، يحتاج المستخدم إلى توجيه LLM بشكل صريح للاستجابة بتنسيق JSON في الـ Prompt، على سبيل المثال: "Tell me a joke about cats, respond in JSON with `setup` and `punchline` keys". وإلا، قد لا تكون هناك استجابة، مما يؤدي إلى خطأ `400 status code (no body)`.

- ستكون الاستجابة عبارة عن سلسلة نصية JSON. يحتاج المستخدم إلى تحليلها باستخدام قدرات عقد سير العمل الأخرى لاستخدام محتواها المنظم. يمكنك أيضًا استخدام ميزة الإخراج المنظم.

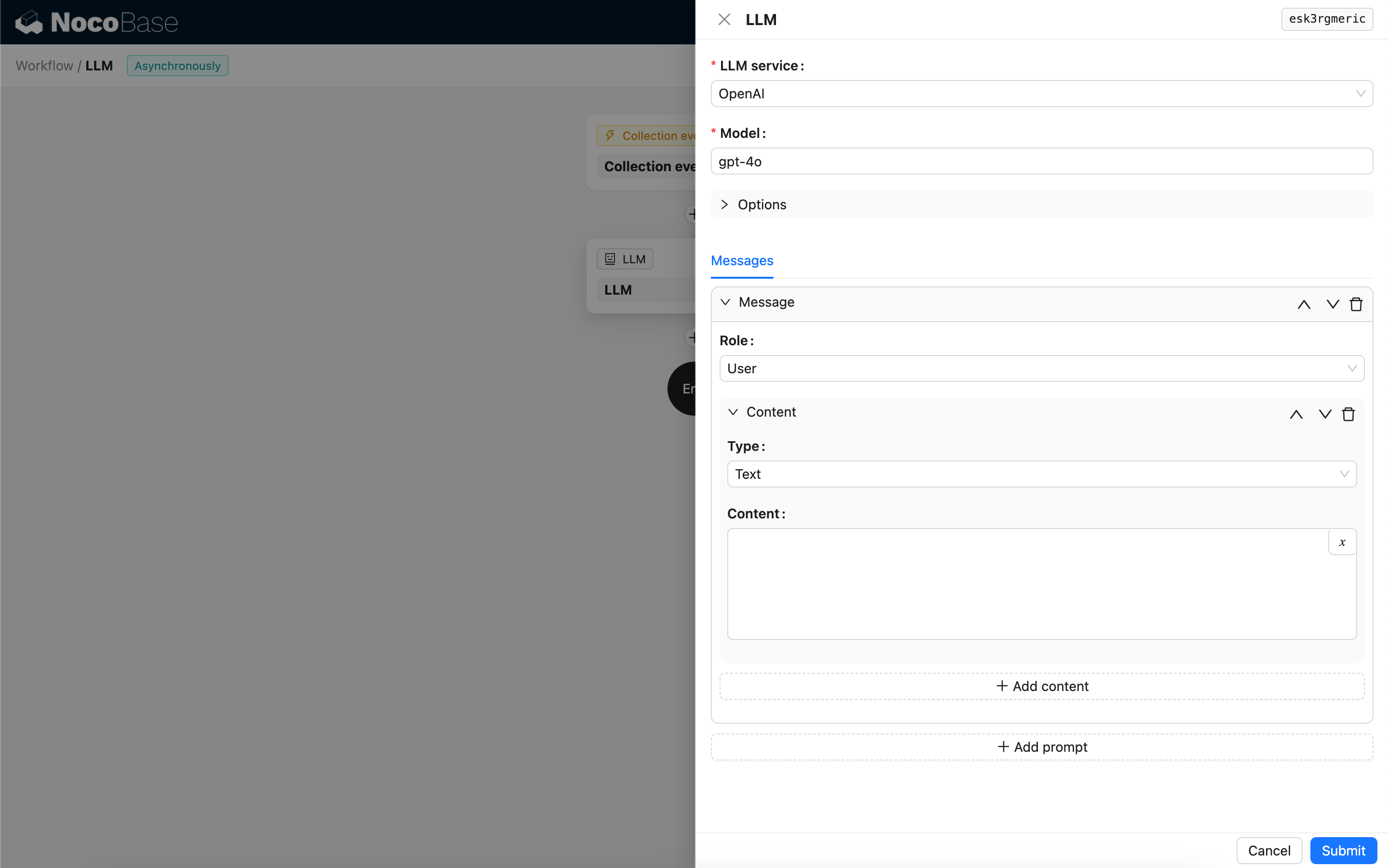

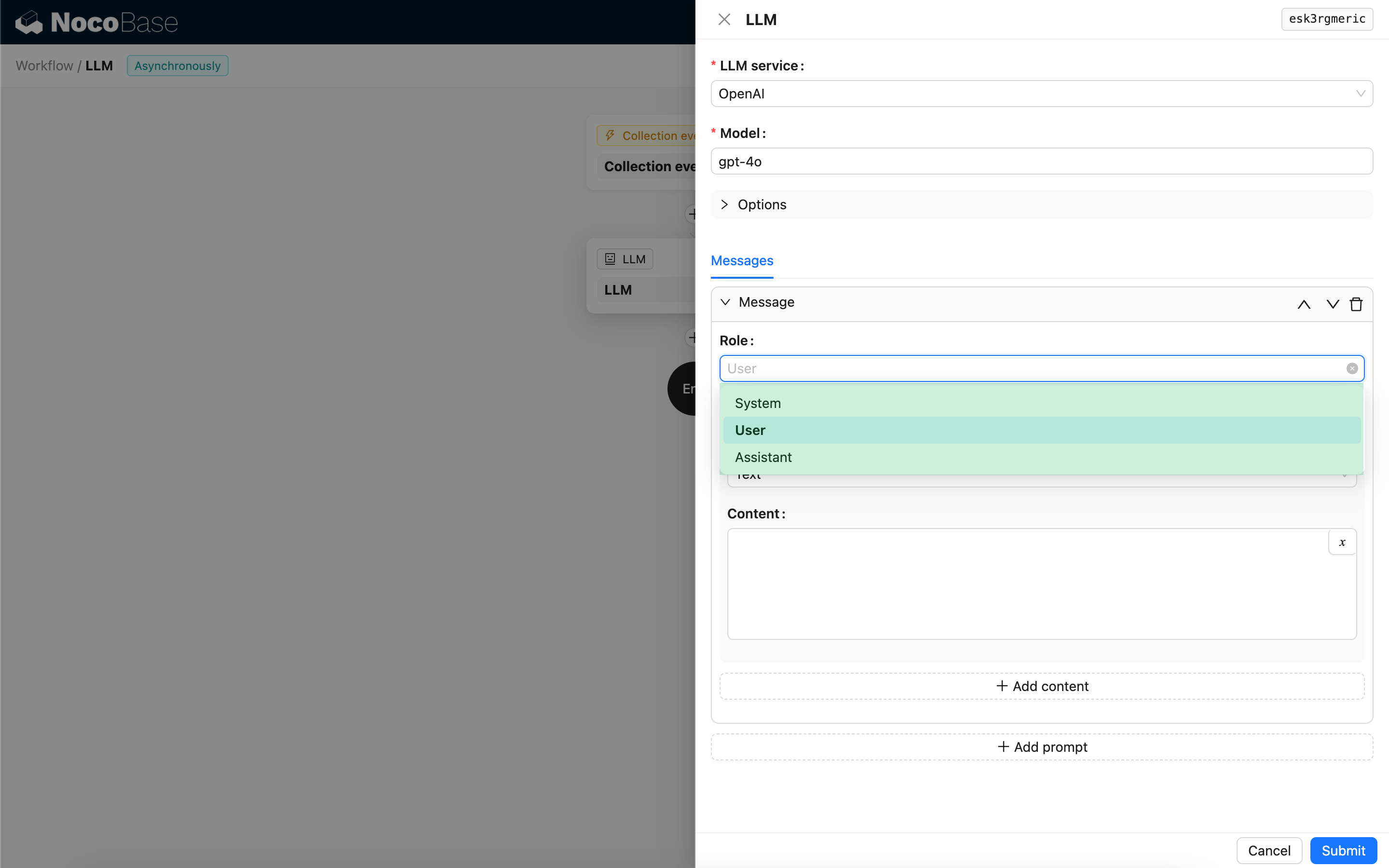

الرسائل

مصفوفة الرسائل المرسلة إلى نموذج LLM يمكن أن تتضمن مجموعة من الرسائل التاريخية. تدعم الرسائل ثلاثة أنواع:

- System - تُستخدم عادةً لتحديد دور وسلوك نموذج LLM في المحادثة.

- User - المحتوى الذي يدخله المستخدم.

- Assistant - المحتوى الذي يستجيب به النموذج.

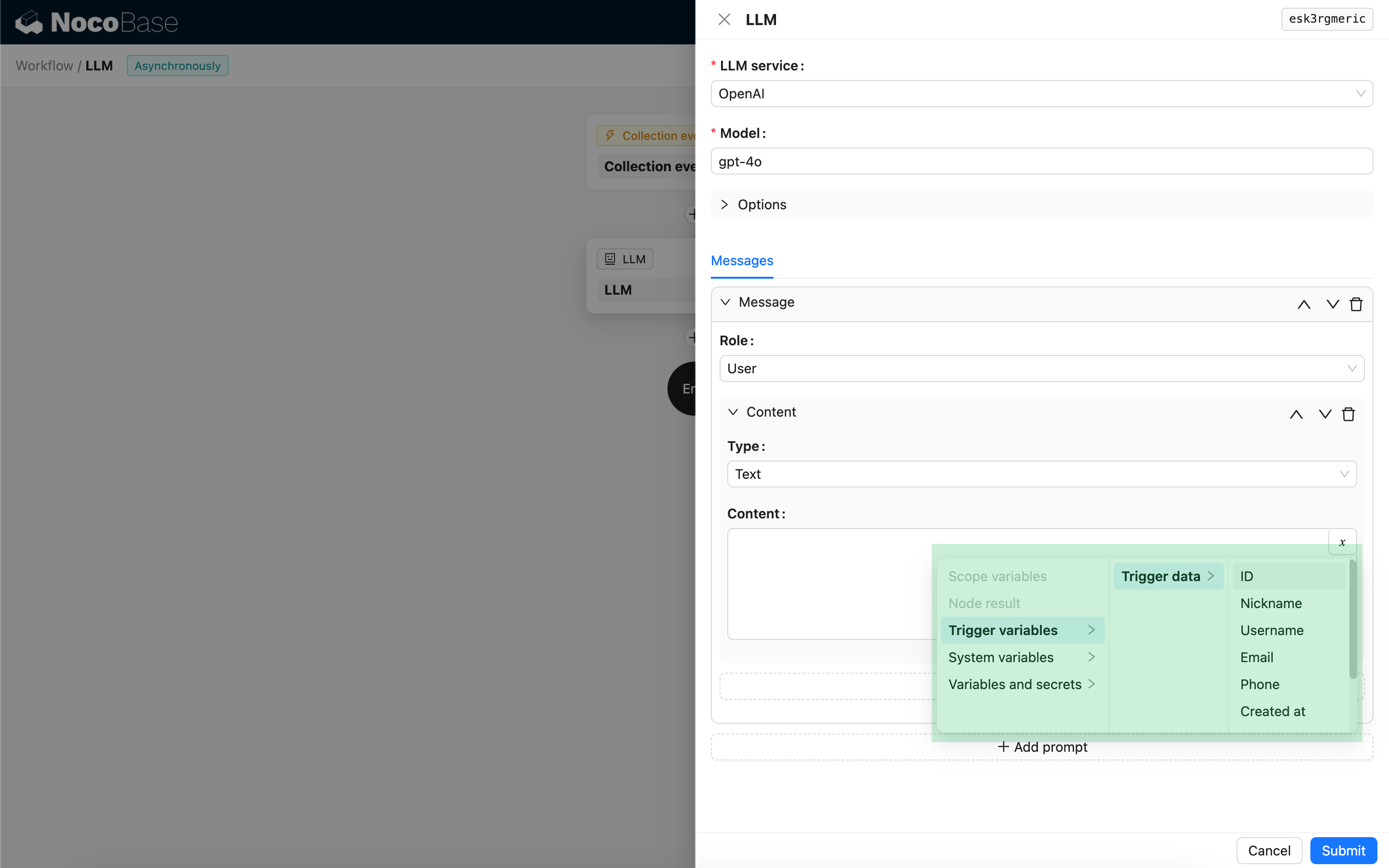

بالنسبة لرسائل المستخدم، شريطة أن يدعم النموذج ذلك، يمكنك إضافة أجزاء متعددة من المحتوى في مطالبة واحدة، تتوافق مع المعلمة `content`. إذا كان النموذج الذي تستخدمه يدعم فقط المعلمة `content` كسلسلة نصية (وهو ما ينطبق على معظم النماذج التي لا تدعم المحادثات متعددة الوسائط)، يرجى تقسيم الرسالة إلى مطالبات متعددة، بحيث يحتوي كل مطالبة على جزء واحد فقط من المحتوى. وبهذه الطريقة، سترسل العقدة المحتوى كسلسلة نصية.

يمكنك استخدام المتغيرات في محتوى الرسالة للإشارة إلى سياق سير العمل.

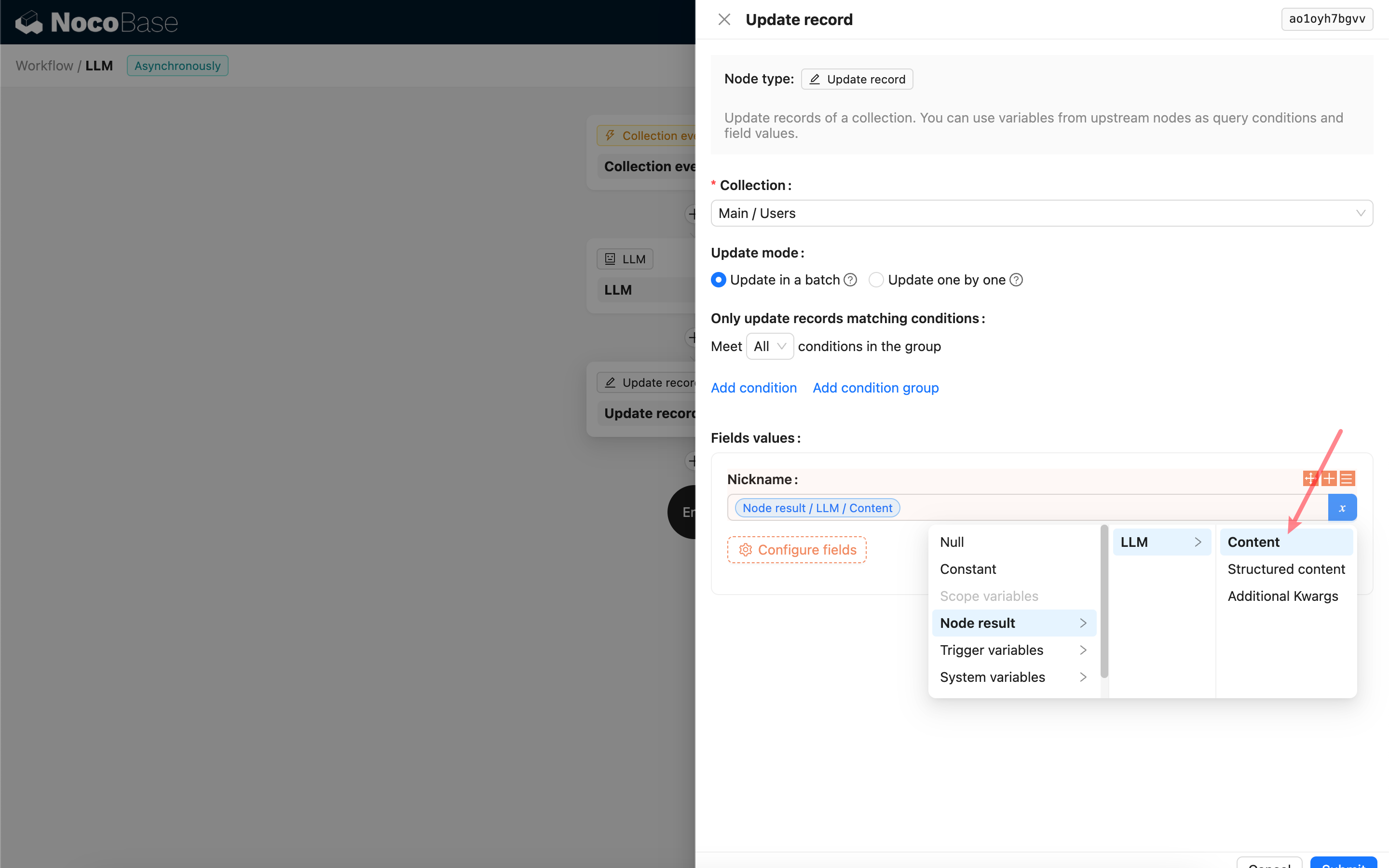

استخدام محتوى استجابة عقدة LLM

يمكنك استخدام محتوى استجابة عقدة LLM كمتغير في العقد الأخرى.