เอกสารนี้แปลโดย AI สำหรับข้อมูลที่ถูกต้อง กรุณาดูเวอร์ชันภาษาอังกฤษ

การสนทนาด้วยข้อความ

พนักงาน AICommunity Edition+บทนำ

การใช้Node LLM ใน Workflow ช่วยให้คุณสามารถเริ่มต้นการสนทนากับบริการ LLM ออนไลน์ได้ โดยใช้ประโยชน์จากความสามารถของโมเดลขนาดใหญ่เพื่อช่วยในการดำเนินงานตามกระบวนการทางธุรกิจต่างๆ ให้สำเร็จ

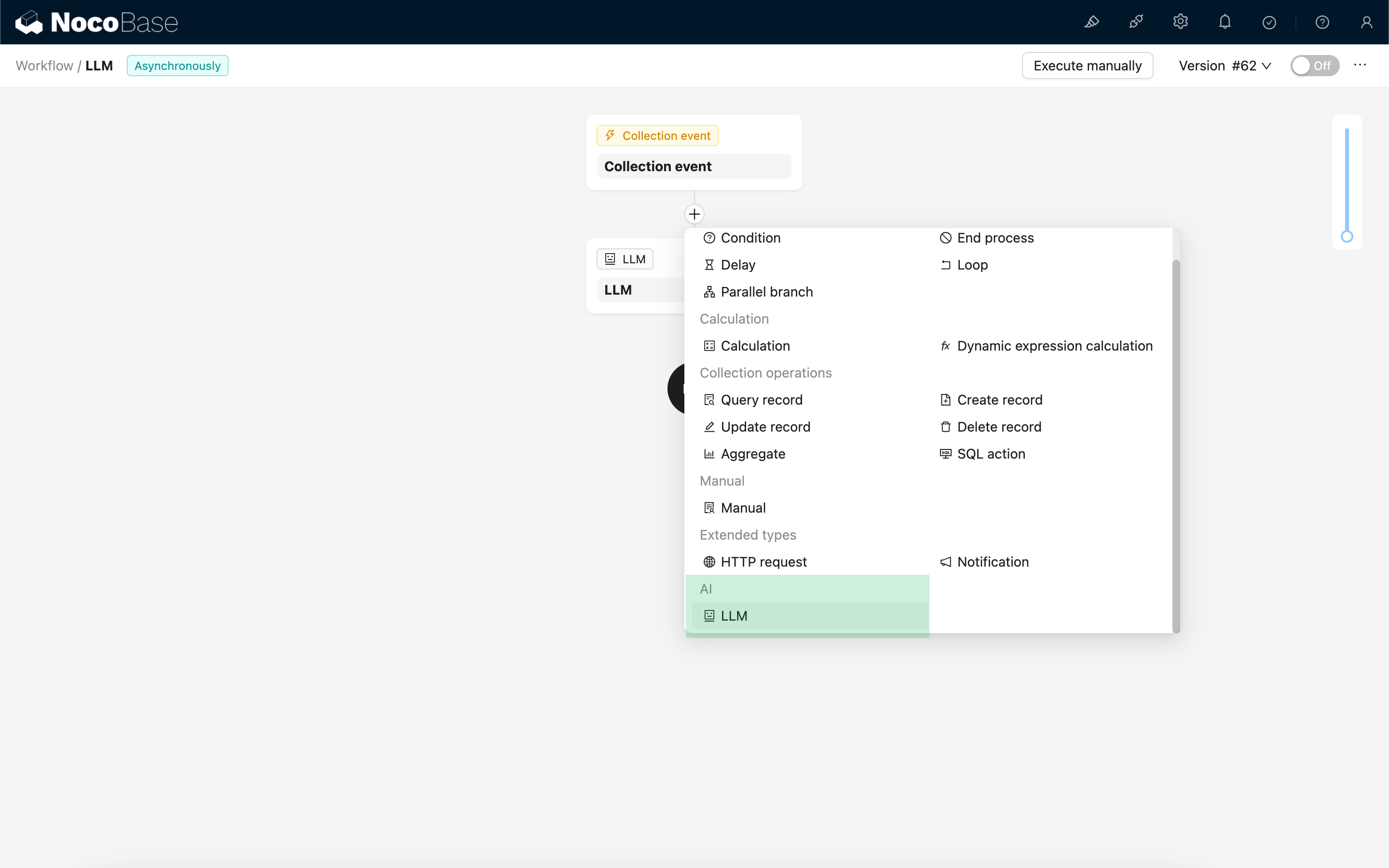

การสร้าง Node LLM

เนื่องจากการสนทนากับบริการ LLM มักใช้เวลานาน Node LLM จึงสามารถใช้ได้เฉพาะใน Workflow แบบ Asynchronous เท่านั้น

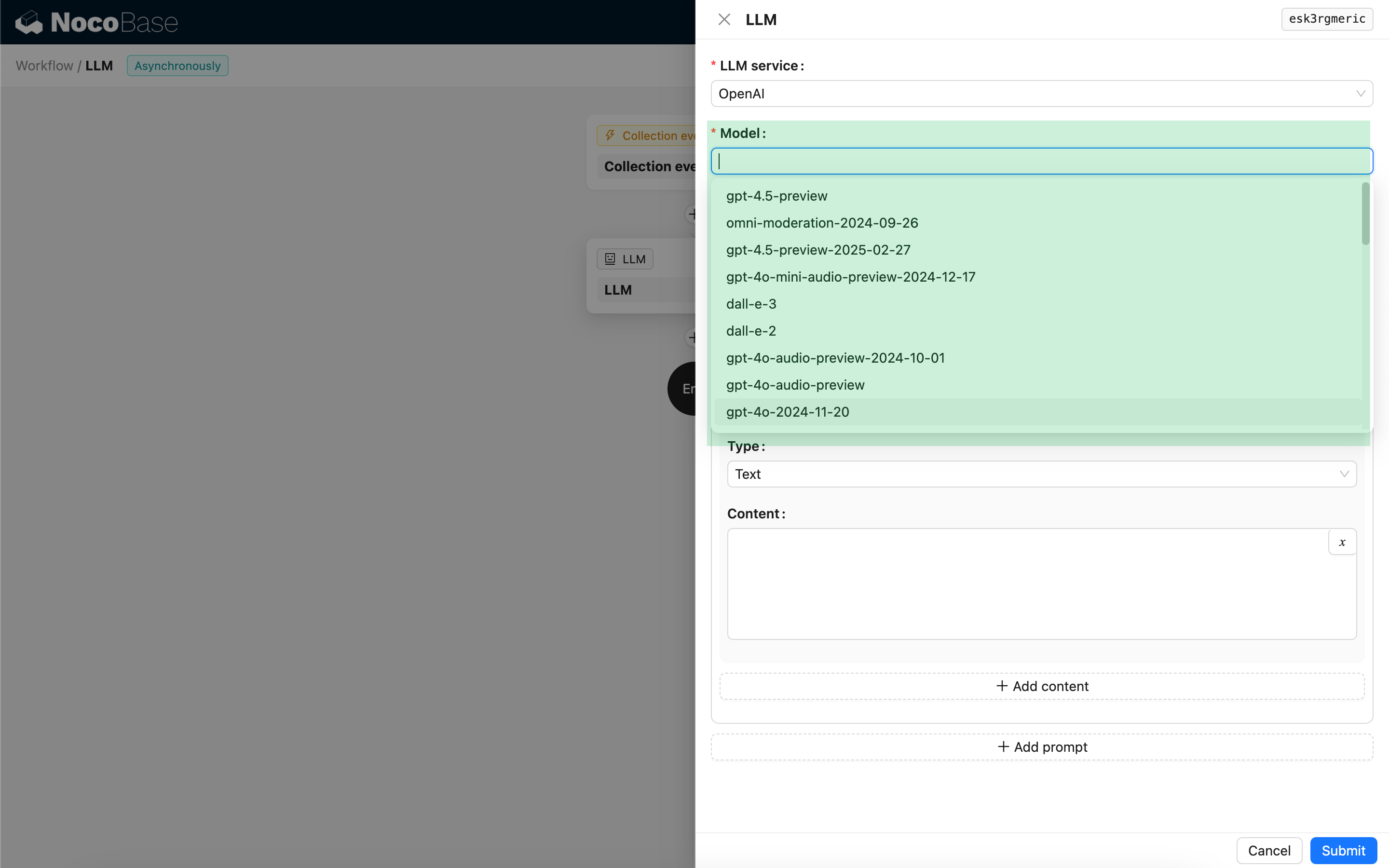

การเลือกโมเดล

อันดับแรก ให้เลือกบริการ LLM ที่เชื่อมต่อไว้แล้ว หากยังไม่ได้เชื่อมต่อบริการ LLM คุณจะต้องเพิ่มการตั้งค่าบริการ LLM ก่อน ดูเพิ่มเติม: การจัดการบริการ LLM

หลังจากเลือกบริการแล้ว แอปพลิเคชันจะพยายามดึงรายการโมเดลที่ใช้งานได้จากบริการ LLM เพื่อให้คุณเลือก บริการ LLM ออนไลน์บางแห่งอาจมี API สำหรับดึงโมเดลที่ไม่เป็นไปตามโปรโตคอล API มาตรฐาน ในกรณีเช่นนี้ ผู้ใช้สามารถป้อน Model ID ด้วยตนเองได้

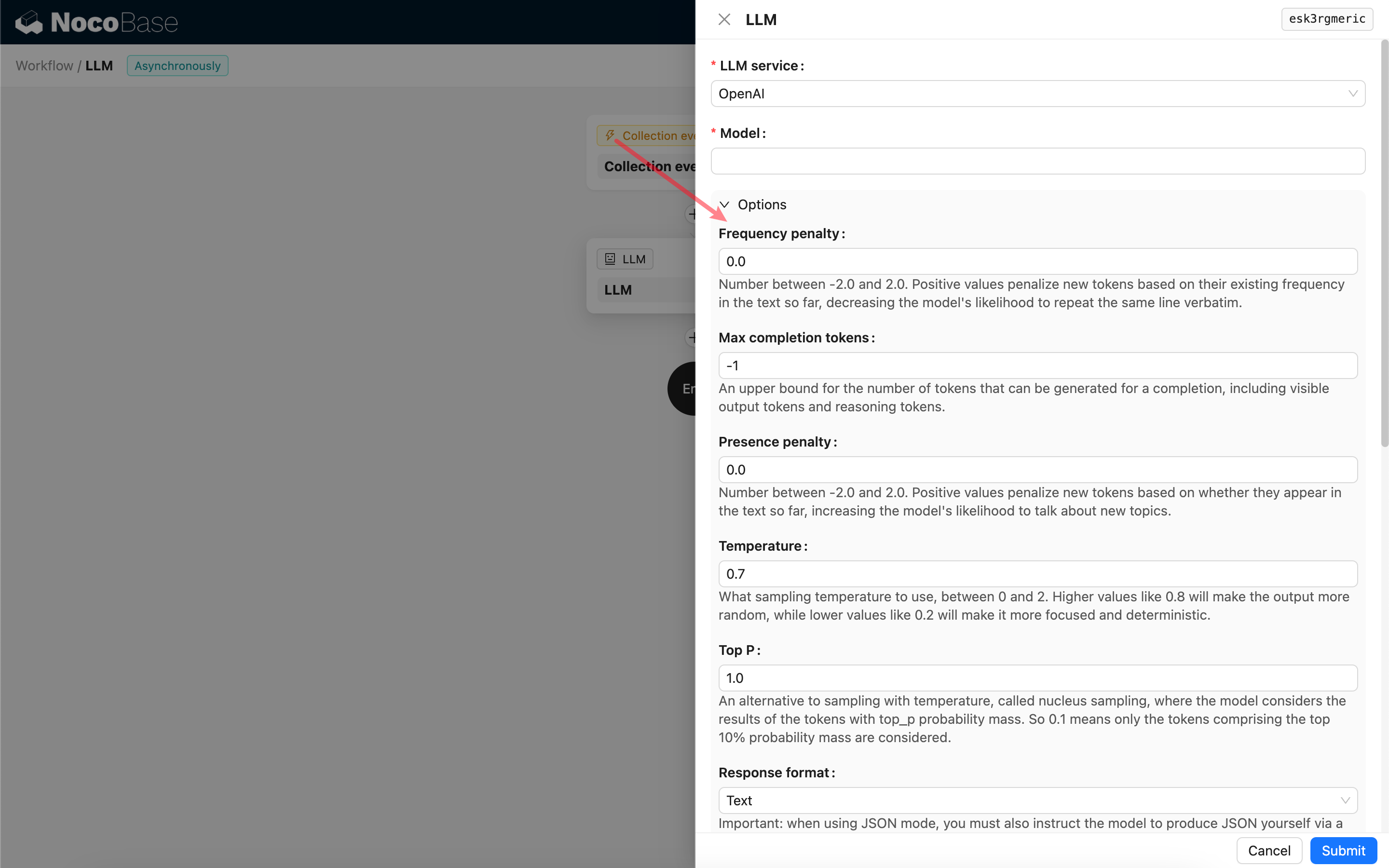

การตั้งค่าพารามิเตอร์การเรียกใช้

คุณสามารถปรับพารามิเตอร์สำหรับการเรียกใช้โมเดล LLM ได้ตามต้องการ

Response format

สิ่งที่ควรทราบคือการตั้งค่า Response format ตัวเลือกนี้ใช้เพื่อแจ้งให้โมเดลขนาดใหญ่ทราบถึงรูปแบบของผลลัพธ์ที่ต้องการ ซึ่งสามารถเป็นข้อความ (Text) หรือ JSON ก็ได้ หากคุณเลือกโหมด JSON โปรดทราบสิ่งต่อไปนี้:

- โมเดล LLM ที่เกี่ยวข้องจะต้องรองรับการเรียกใช้ในโหมด JSON นอกจากนี้ ผู้ใช้จำเป็นต้องระบุอย่างชัดเจนใน Prompt ให้ LLM ตอบกลับในรูปแบบ JSON ตัวอย่างเช่น: "Tell me a joke about cats, respond in JSON with `setup` and `punchline` keys" มิฉะนั้น อาจไม่มีการตอบกลับ หรือเกิดข้อผิดพลาด

400 status code (no body)ได้ครับ/ค่ะ - ผลลัพธ์ที่ได้จะเป็นสตริง JSON ผู้ใช้จำเป็นต้องแยกวิเคราะห์ (parse) ด้วยความสามารถของNode อื่นๆ ใน Workflow ก่อน จึงจะสามารถนำเนื้อหาที่มีโครงสร้างไปใช้งานได้ คุณยังสามารถใช้ฟังก์ชัน Structured Output ได้

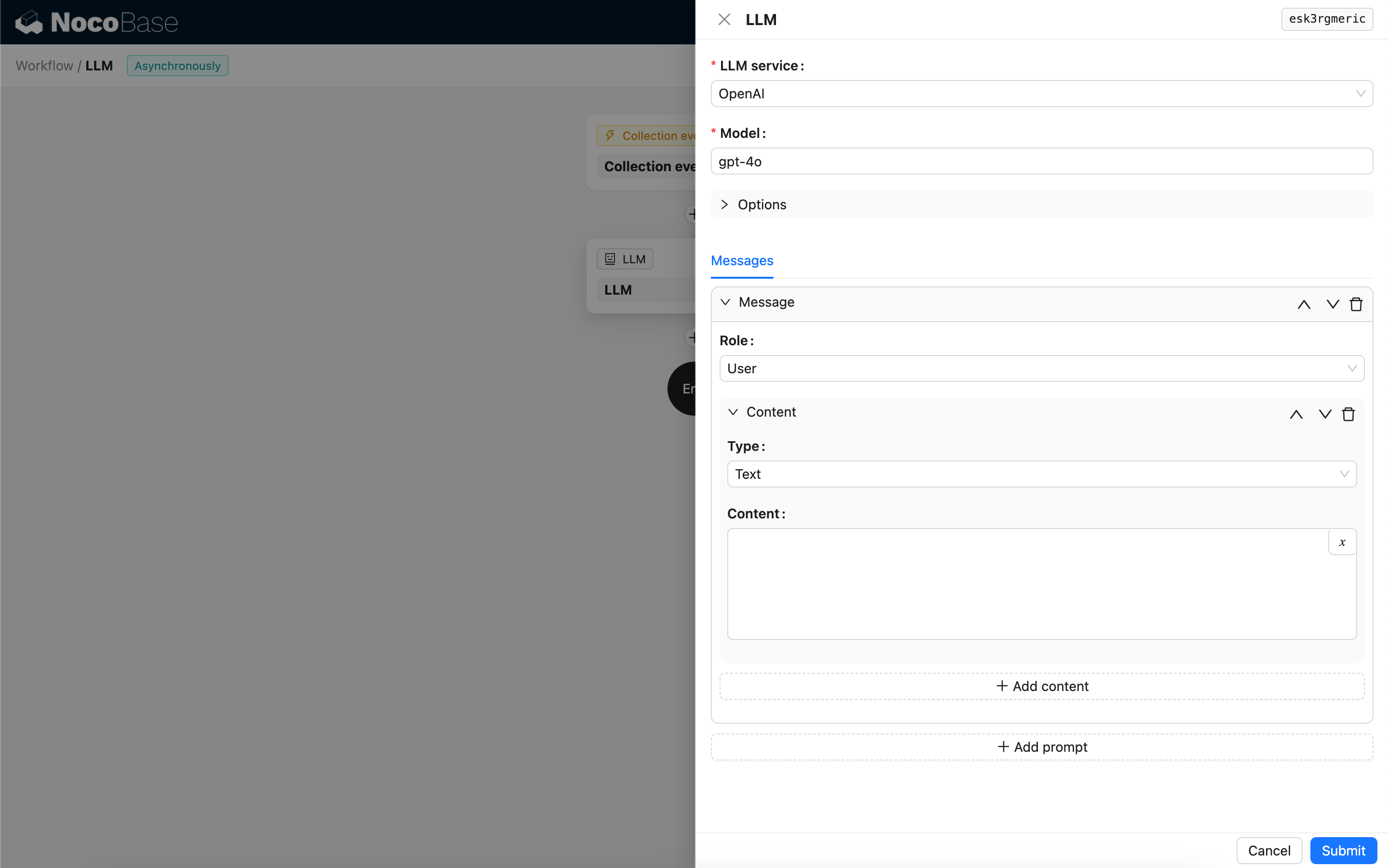

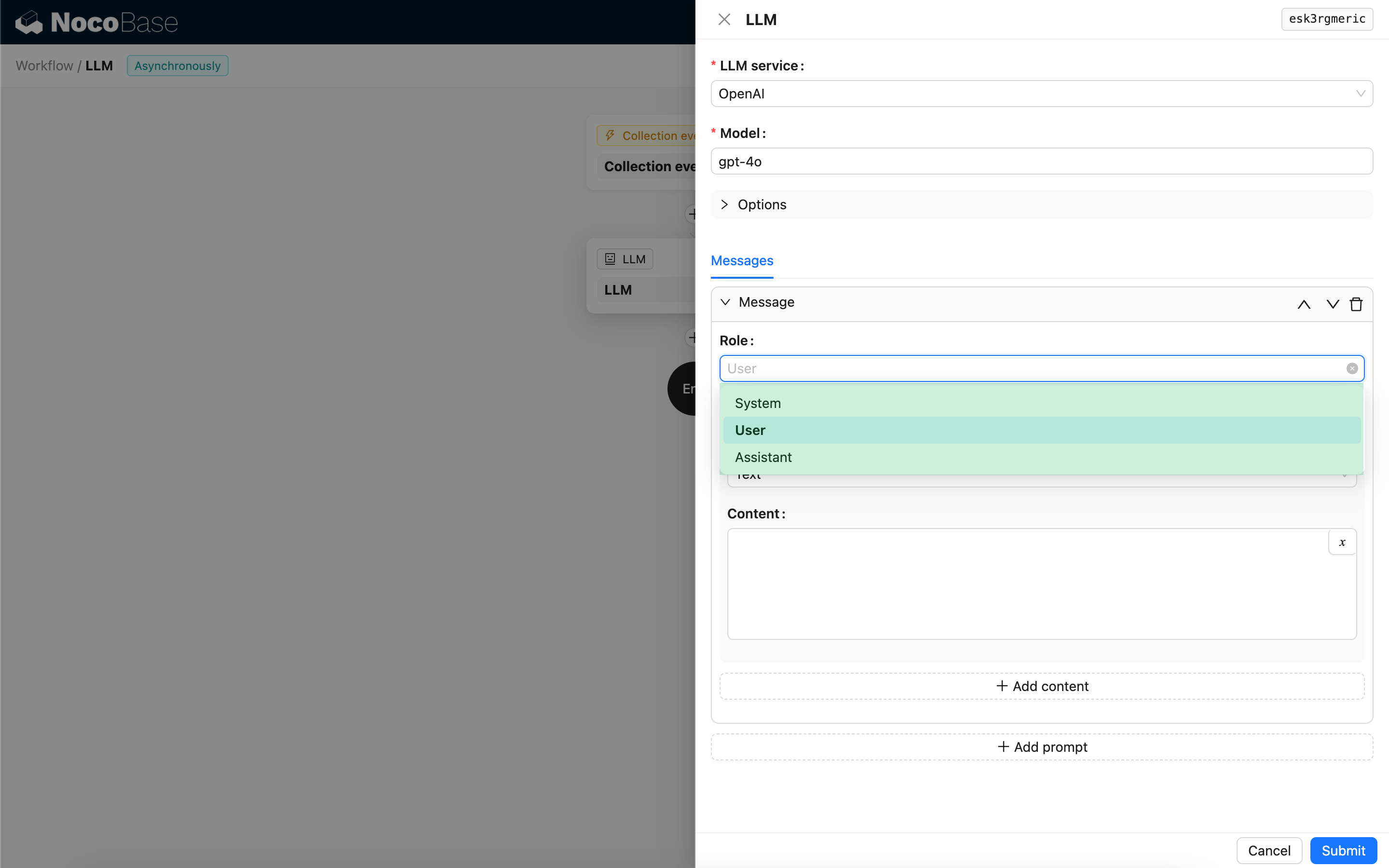

ข้อความ

อาร์เรย์ของข้อความที่ส่งไปยังโมเดล LLM สามารถรวมชุดข้อความประวัติได้ โดยข้อความรองรับสามประเภทดังนี้:

- System - โดยทั่วไปใช้เพื่อกำหนดบทบาทและพฤติกรรมของโมเดล LLM ในการสนทนา

- User - เนื้อหาที่ผู้ใช้ป้อน

- Assistant - เนื้อหาที่โมเดลตอบกลับ

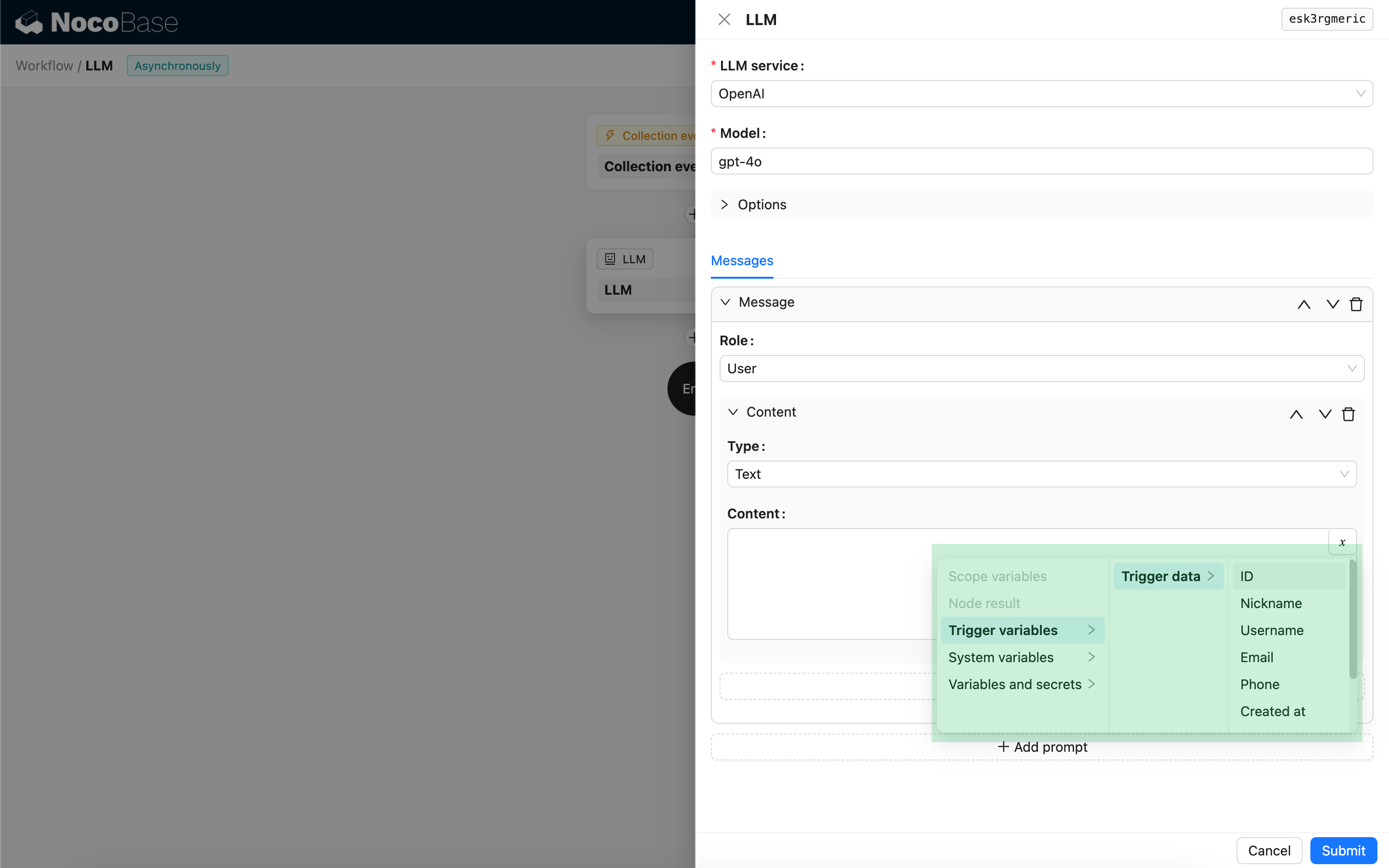

สำหรับข้อความของผู้ใช้ หากโมเดลรองรับ คุณสามารถเพิ่มเนื้อหาหลายส่วนใน Prompt เดียวกันได้ ซึ่งจะตรงกับพารามิเตอร์ content ครับ/ค่ะ หากโมเดลที่คุณใช้รองรับเฉพาะพารามิเตอร์ content ในรูปแบบสตริงเท่านั้น (ซึ่งเป็นกรณีของโมเดลส่วนใหญ่ที่ไม่รองรับการสนทนาแบบหลายโมดอล) โปรดแยกข้อความเป็นหลาย Prompt โดยแต่ละ Prompt ให้มีเนื้อหาเพียงส่วนเดียว ด้วยวิธีนี้ โหนดจะส่งเนื้อหาเป็นสตริง

คุณสามารถใช้ตัวแปรในเนื้อหาข้อความเพื่ออ้างอิงบริบทของWorkflow ได้

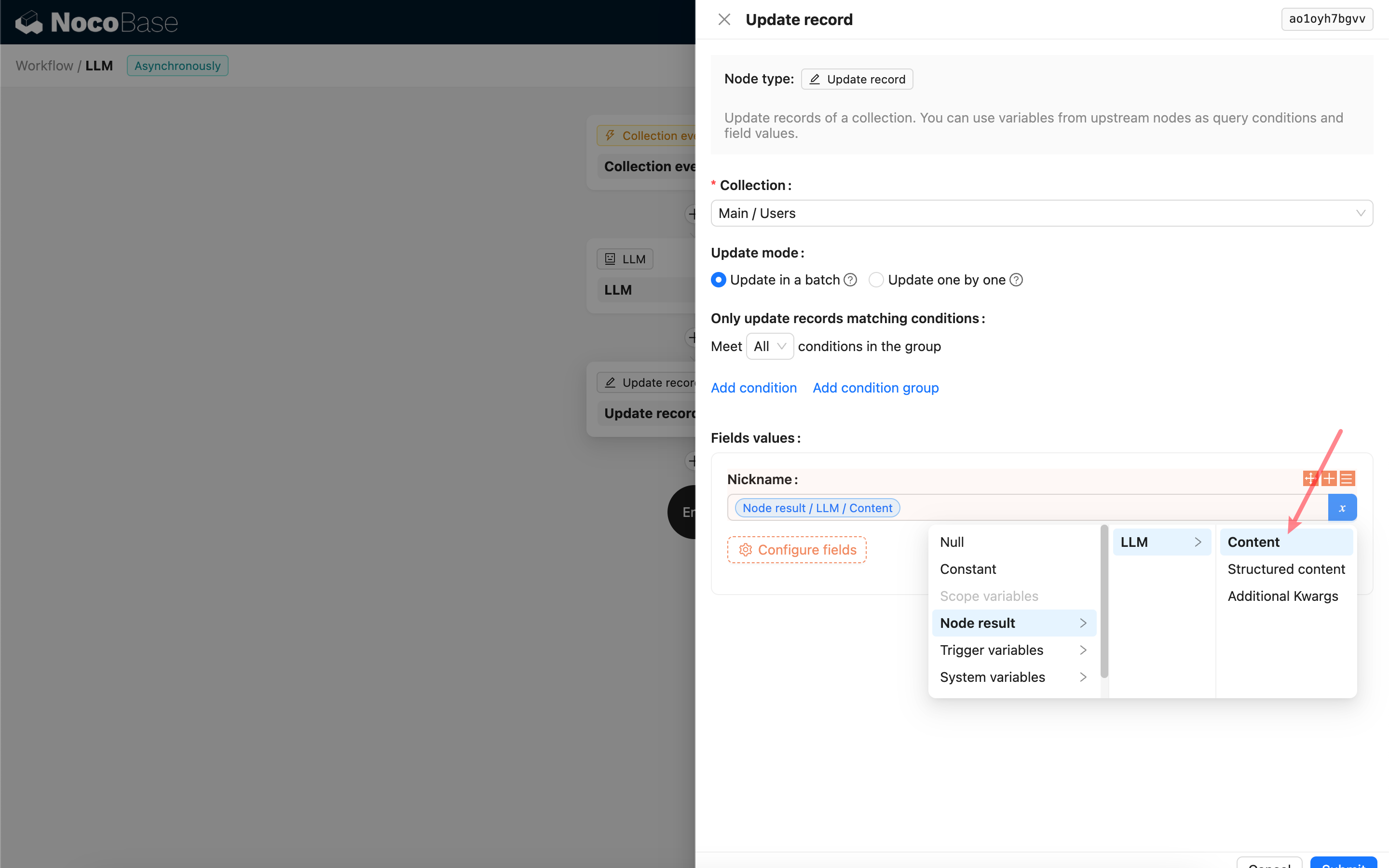

การใช้เนื้อหาการตอบกลับของ Node LLM

คุณสามารถใช้เนื้อหาการตอบกลับของNode LLM เป็นตัวแปรใน Node อื่นๆ ได้