Этот документ был переведён с помощью ИИ. Для получения точной информации обратитесь к английской версии.

Текстовый диалог

AI-сотрудникиCommunity Edition+Введение

Используя LLM-узел рабочего процесса, вы можете инициировать диалог с онлайн-сервисом LLM, задействуя возможности больших моделей для помощи в выполнении ряда бизнес-процессов.

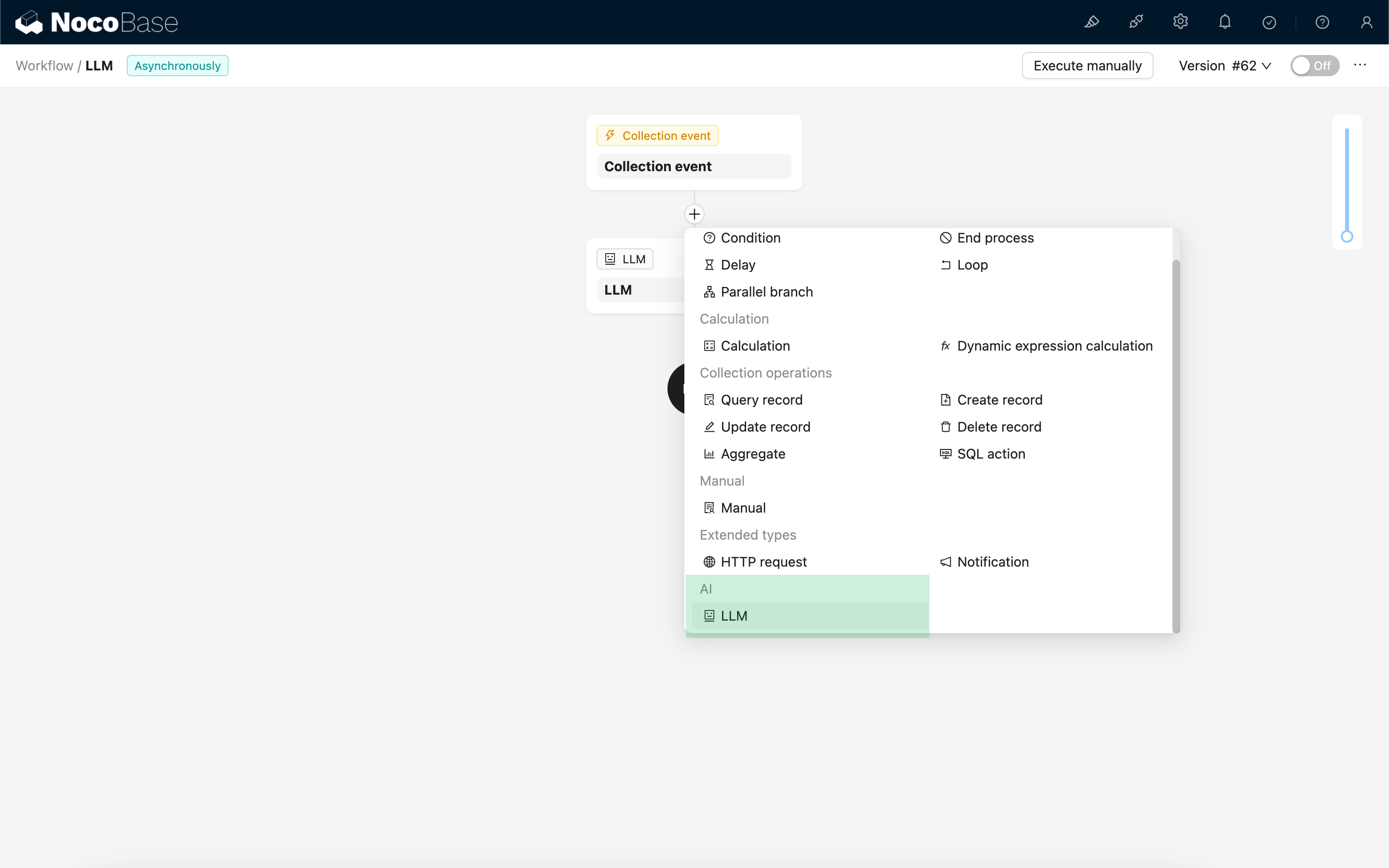

Создание LLM-узла

Поскольку диалог с LLM-сервисом обычно занимает много времени, LLM-узел можно использовать только в асинхронных рабочих процессах.

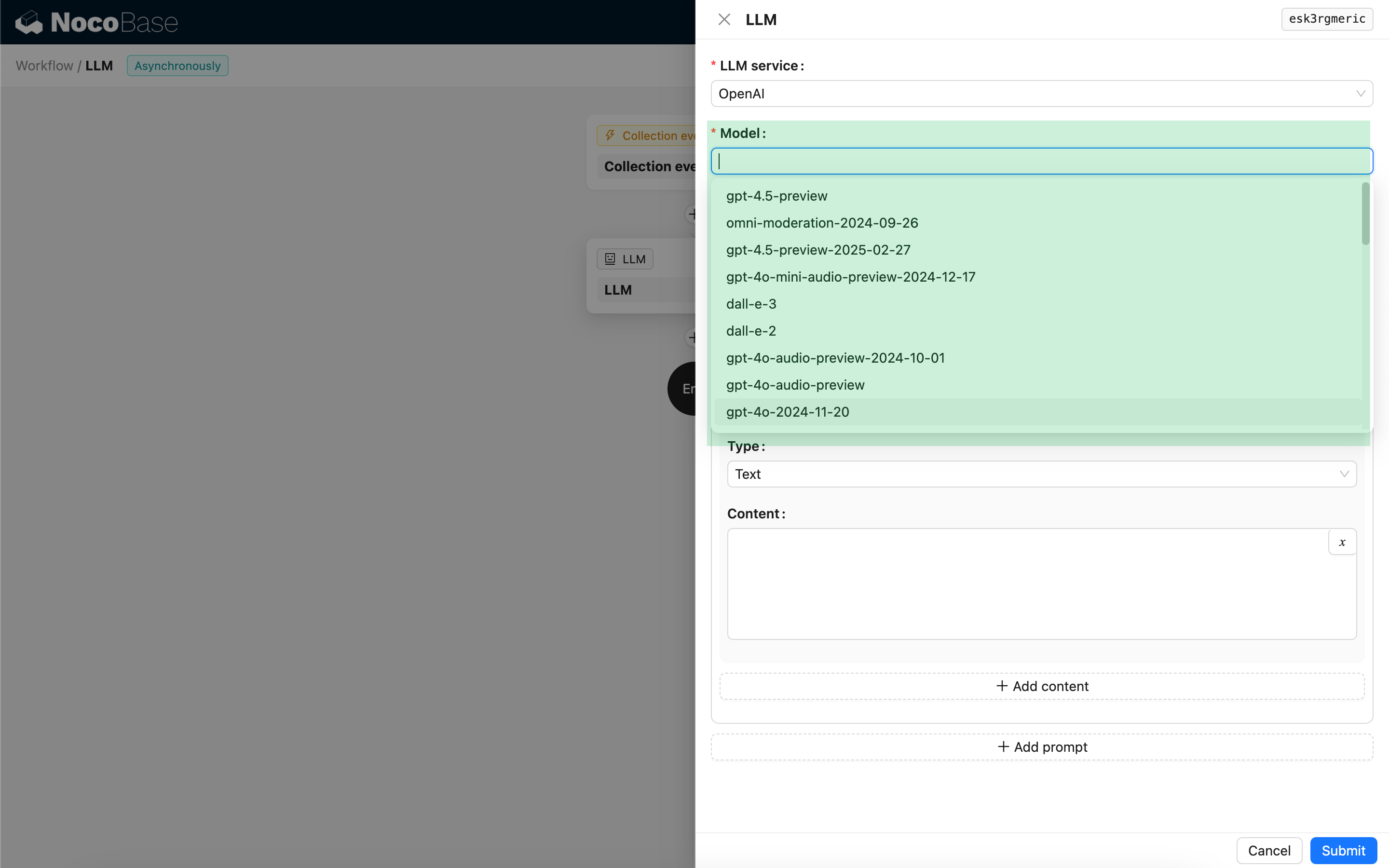

Выбор модели

Сначала выберите подключенный LLM-сервис. Если вы еще не подключили LLM-сервис, необходимо сначала добавить конфигурацию LLM-сервиса. См.: Управление LLM-сервисами

После выбора сервиса приложение попытается получить список доступных моделей из LLM-сервиса для выбора. Интерфейсы получения моделей некоторых онлайн-сервисов LLM могут не соответствовать стандартному протоколу API, поэтому пользователи также могут ввести ID модели вручную.

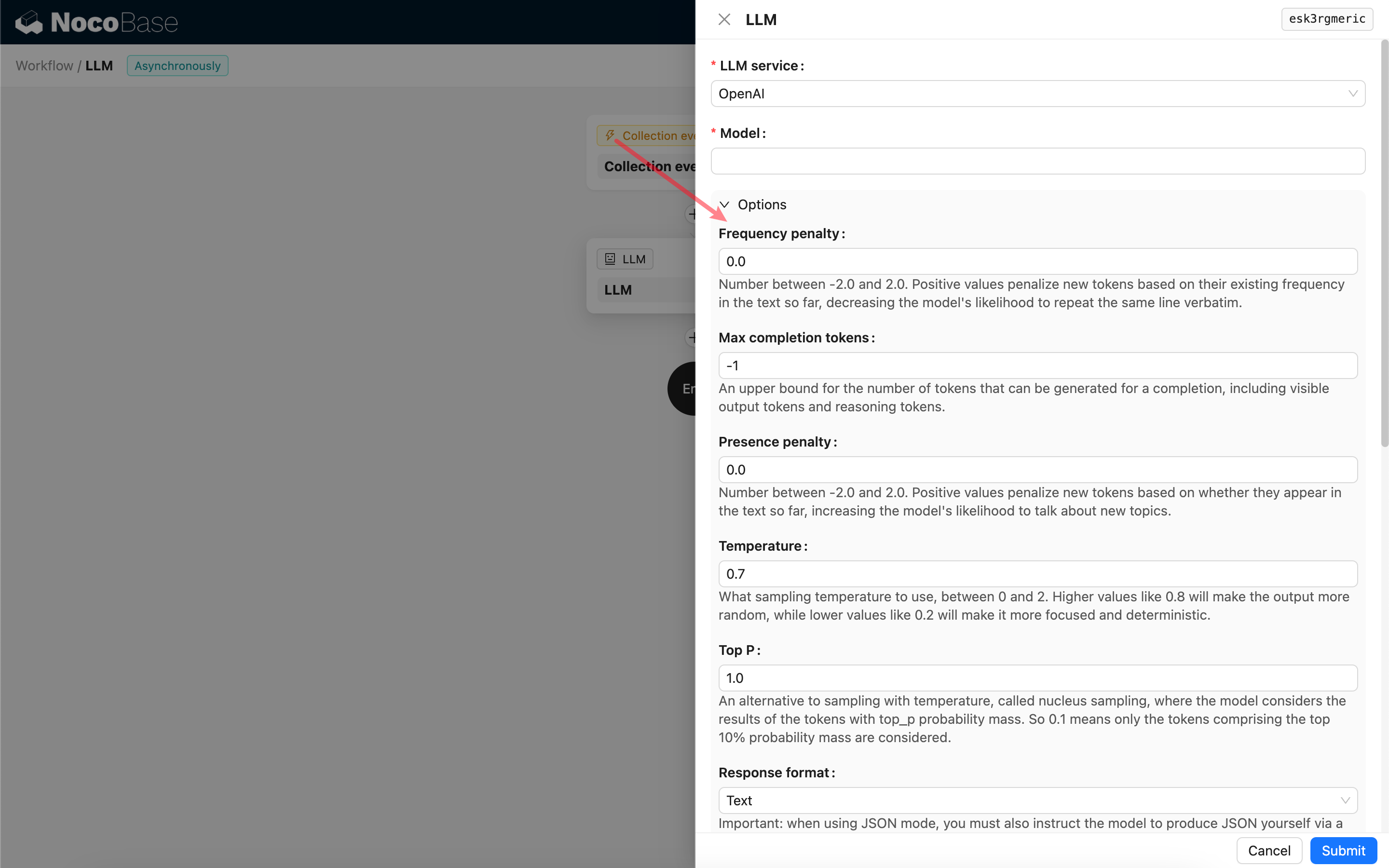

Настройка параметров вызова

Вы можете настроить параметры вызова LLM-модели по мере необходимости.

Response format

Среди них стоит обратить внимание на настройку Response format, которая используется для указания формату содержимого ответа большой модели: это может быть текст или JSON. Если выбран режим JSON, следует учесть:

- Соответствующая LLM-модель должна поддерживать вызов в режиме JSON, при этом пользователю необходимо явно указать в Prompt, чтобы LLM ответила в формате JSON, например: "Tell me a joke about cats, respond in JSON with `setup` and `punchline` keys". В противном случае ответ может отсутствовать, и возникнет ошибка

400 status code (no body). - Результат ответа представляет собой JSON-строку. Пользователю необходимо использовать возможности других узлов рабочего процесса для ее парсинга, прежде чем можно будет использовать структурированное содержимое. Также можно воспользоваться функцией Структурированный вывод.

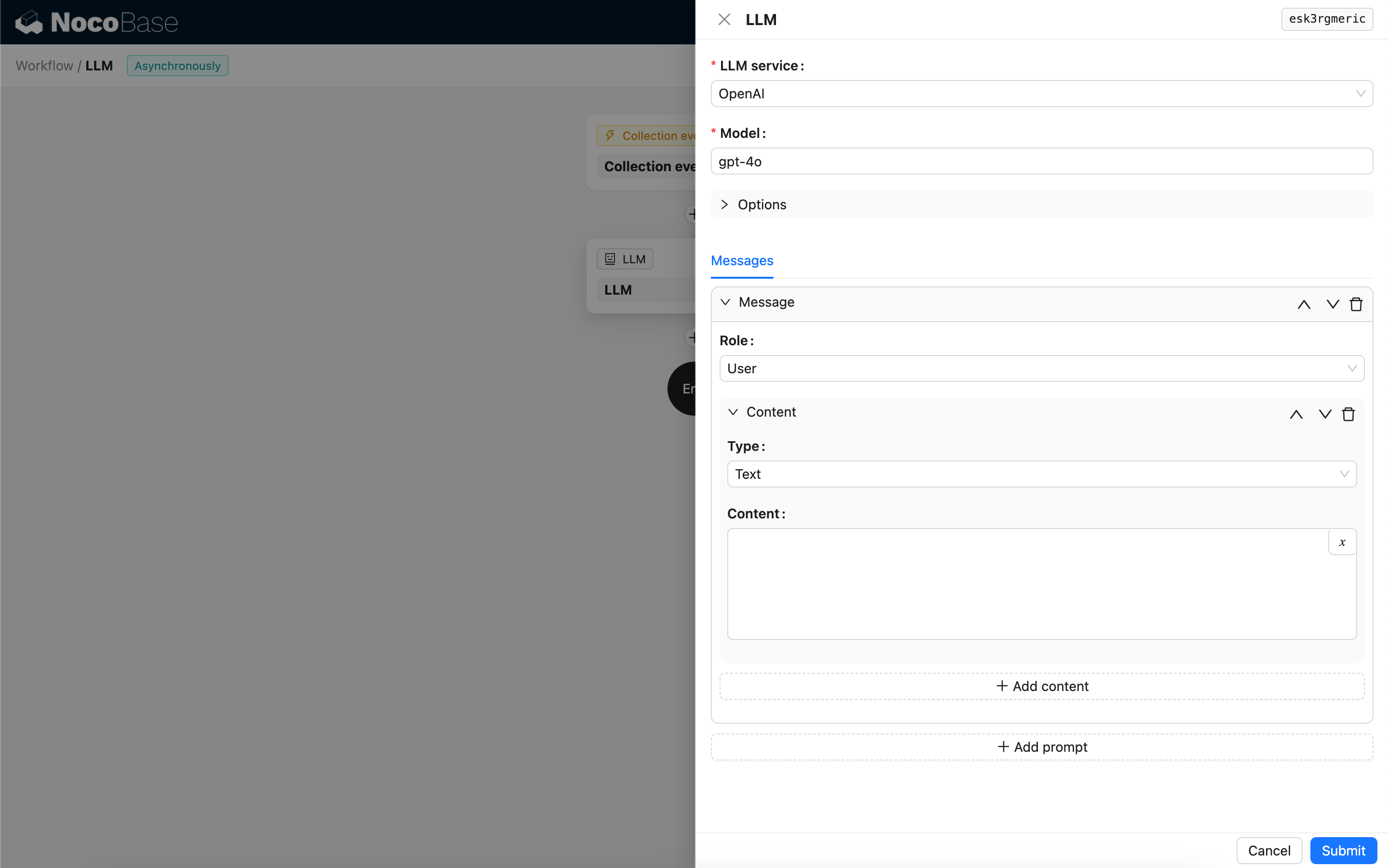

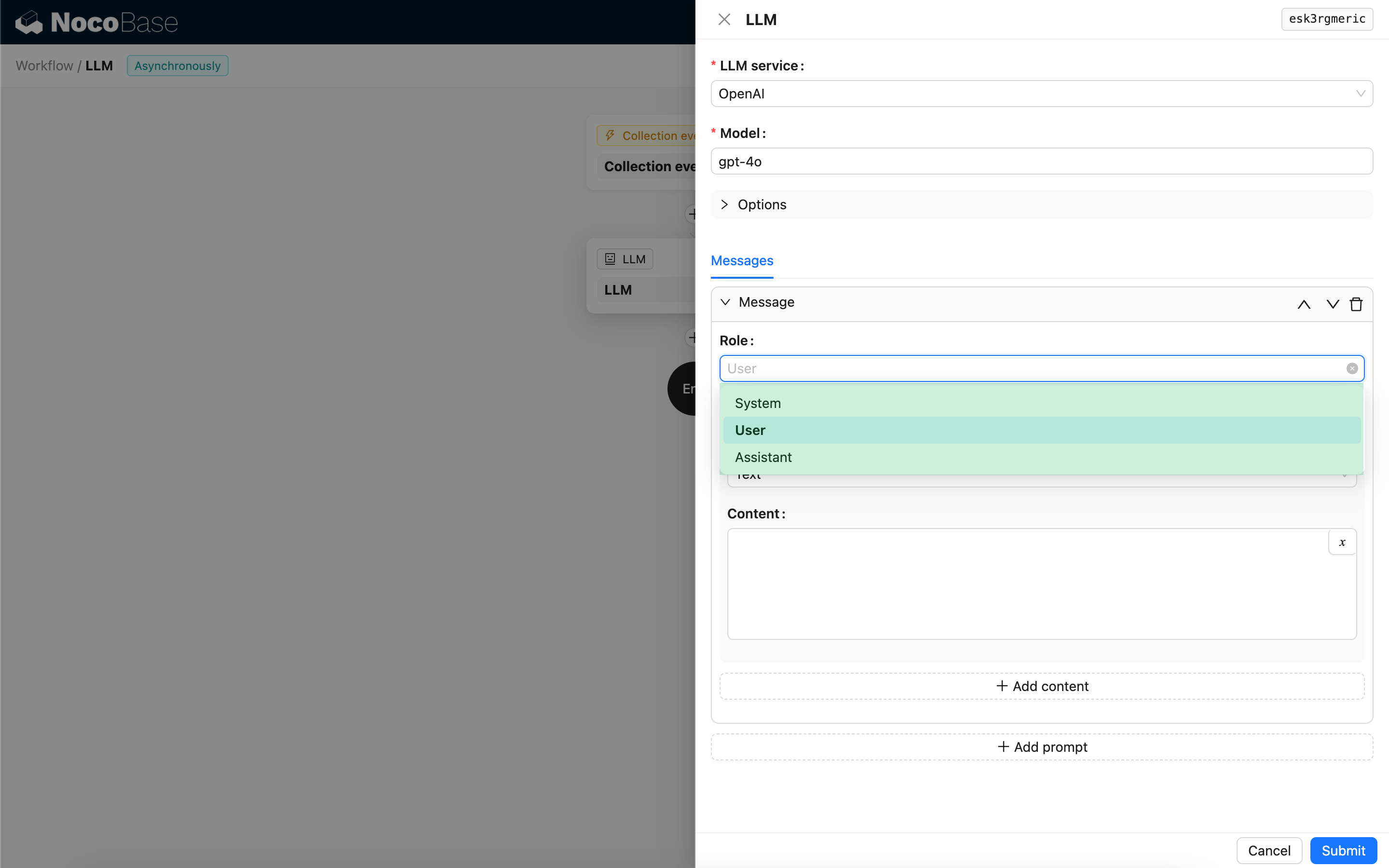

Сообщения

Массив сообщений, отправляемых LLM-модели, может содержать набор исторических сообщений. Сообщения поддерживают три типа:

- System — обычно используется для определения роли и поведения LLM-модели в диалоге.

- User — содержимое, введенное пользователем.

- Assistant — содержимое ответа модели.

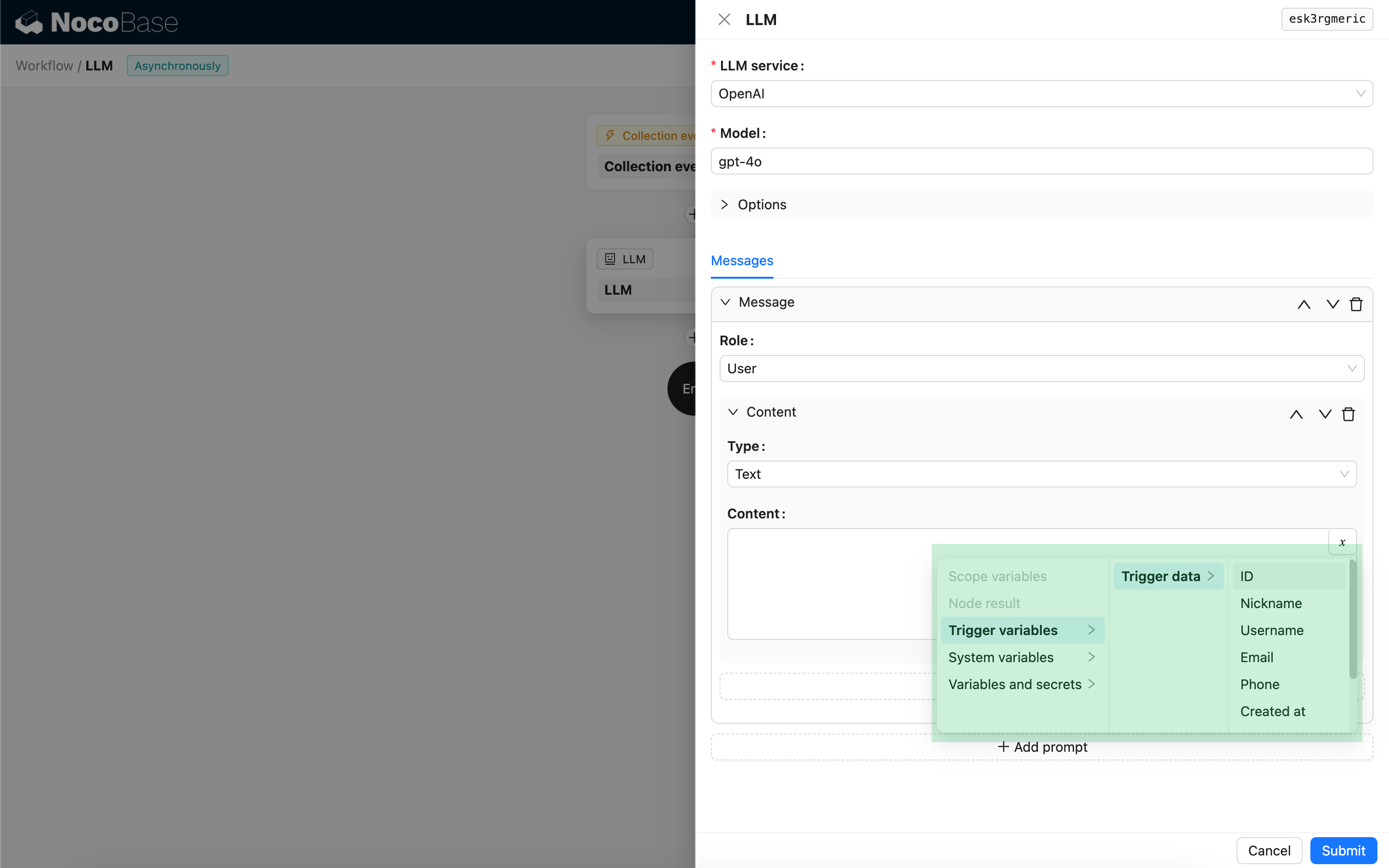

Для пользовательских сообщений, при условии поддержки моделью, в одну подсказку можно добавить несколько элементов содержимого, что соответствует параметру content. Если используемая модель поддерживает параметр content только в виде строки (к этой категории относится большинство моделей, не поддерживающих мультимодальные диалоги), разделите сообщение на несколько подсказок, оставив в каждой только один элемент содержимого — так узел отправит содержимое в виде строки.

В содержимом сообщений можно использовать переменные для ссылки на контекст рабочего процесса.

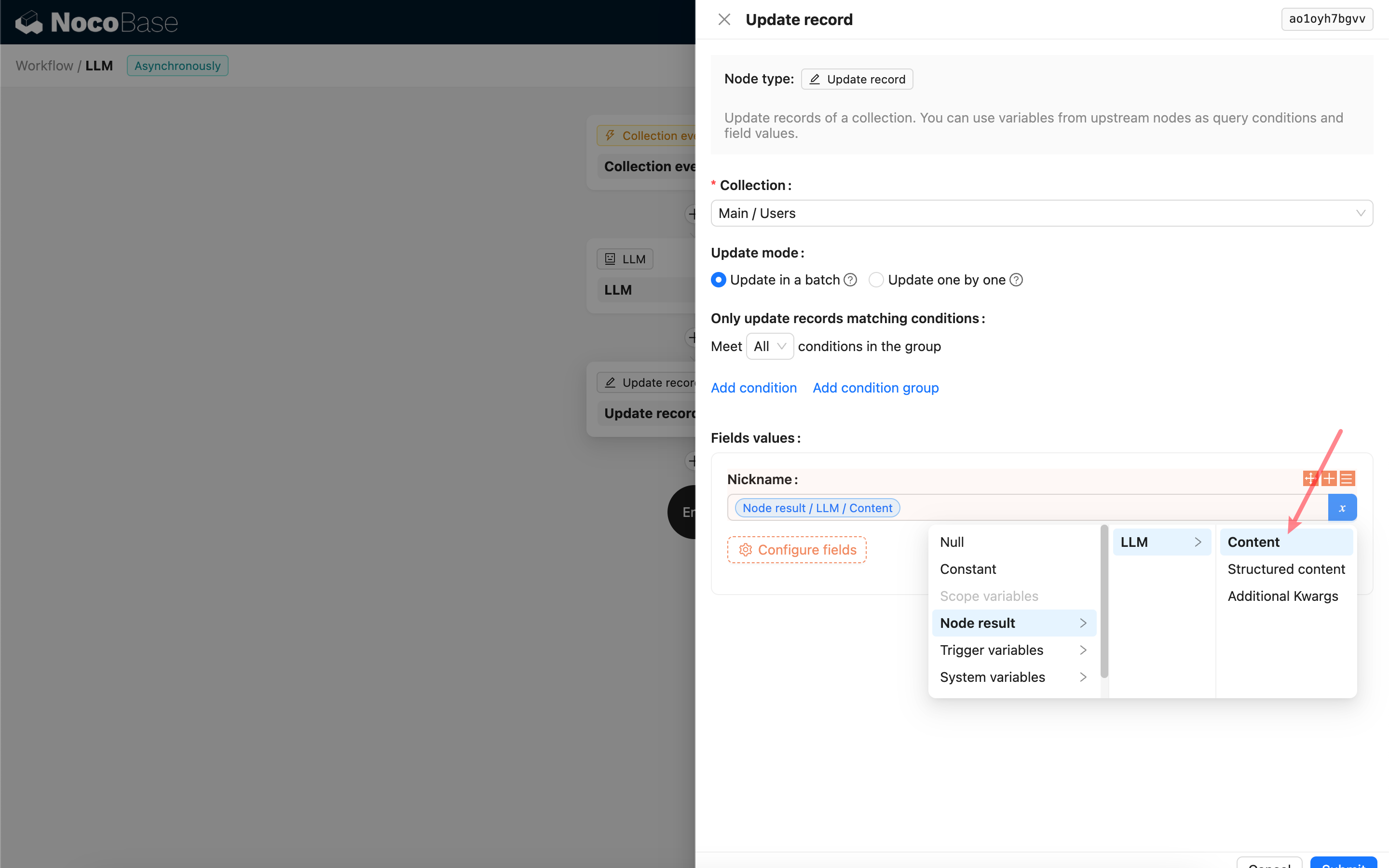

Использование содержимого ответа LLM-узла

Содержимое ответа LLM-узла можно использовать в качестве переменной в других узлах.