Цей документ було перекладено за допомогою ШІ. Для точної інформації зверніться до англійської версії.

Текстовий діалог

AI-співробітникиCommunity Edition+Вступ

Використовуючи вузол LLM у робочому процесі, ви можете ініціювати діалог з онлайн-сервісом LLM, використовуючи можливості великих моделей для допомоги у виконанні серії бізнес-процесів.

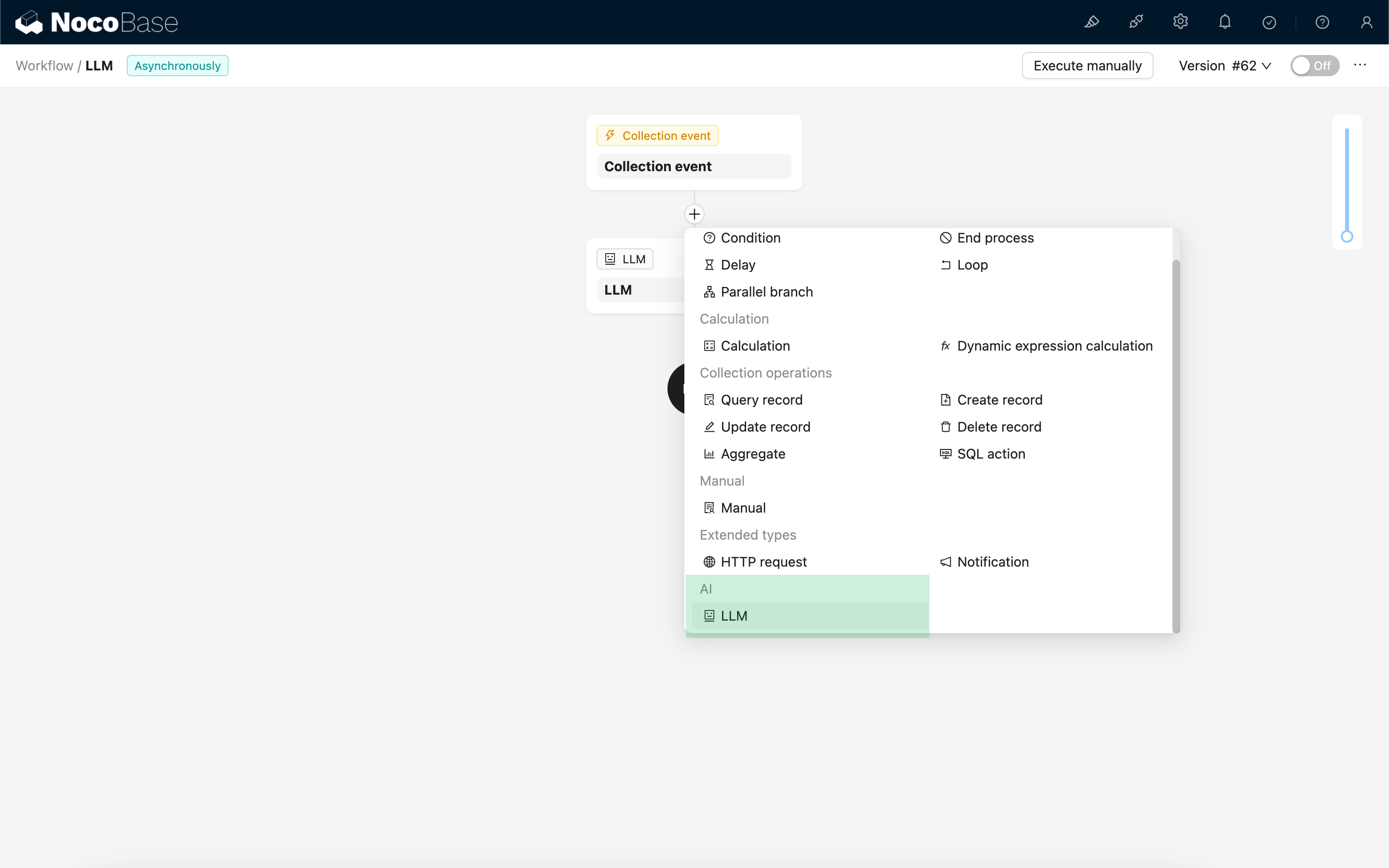

Створення вузла LLM

Оскільки діалог із сервісом LLM зазвичай займає багато часу, вузол LLM можна використовувати лише в асинхронних робочих процесах.

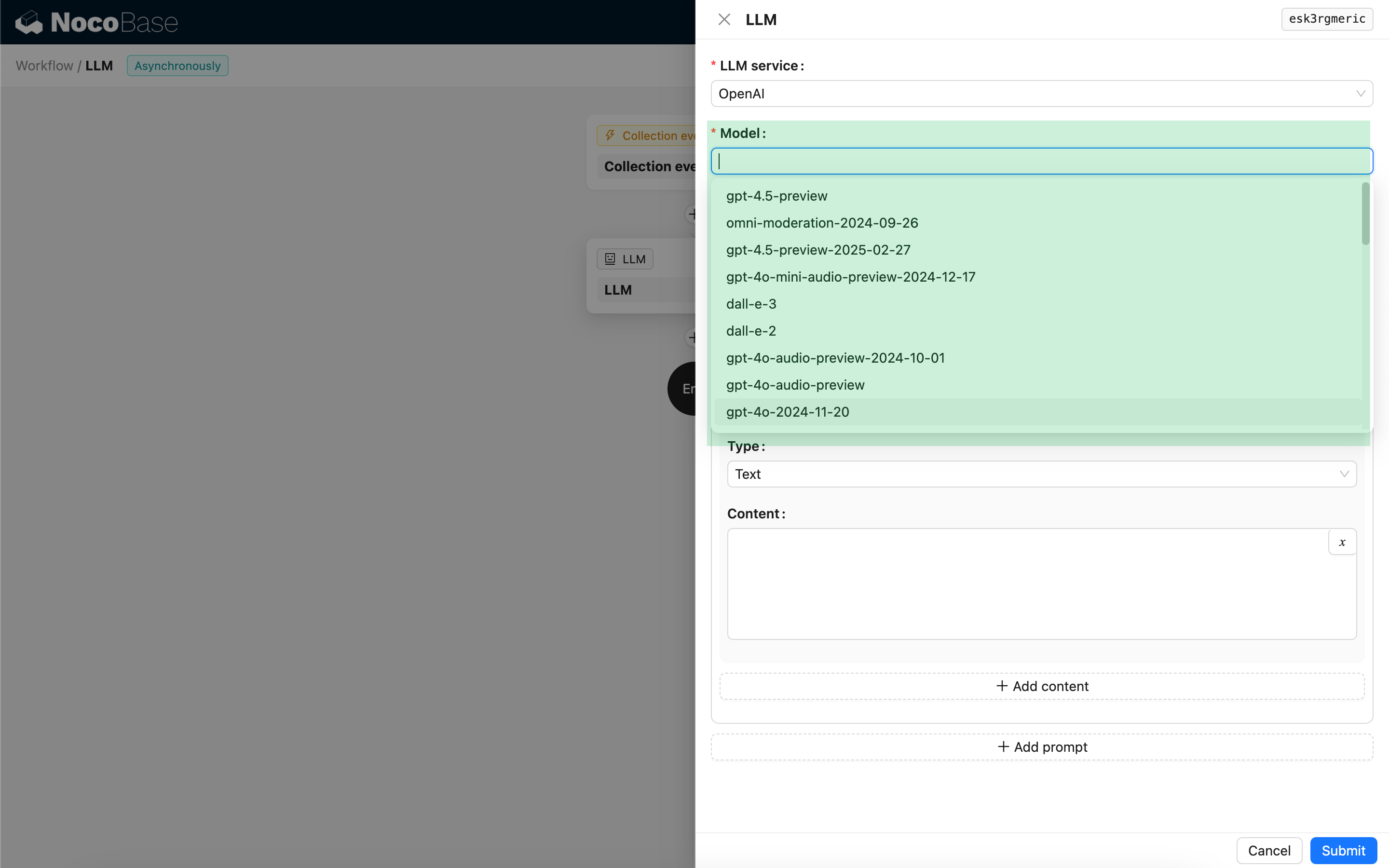

Вибір моделі

Спочатку виберіть підключений сервіс LLM. Якщо сервіс LLM ще не підключено, спочатку потрібно додати конфігурацію сервісу LLM. Див.: Керування сервісом LLM

Після вибору сервісу застосунок спробує отримати список доступних моделей із сервісу LLM для вибору. Деякі онлайн-сервіси LLM можуть мати інтерфейси для отримання моделей, які не відповідають стандартним протоколам API, тому користувачі також можуть ввести ID моделі вручну.

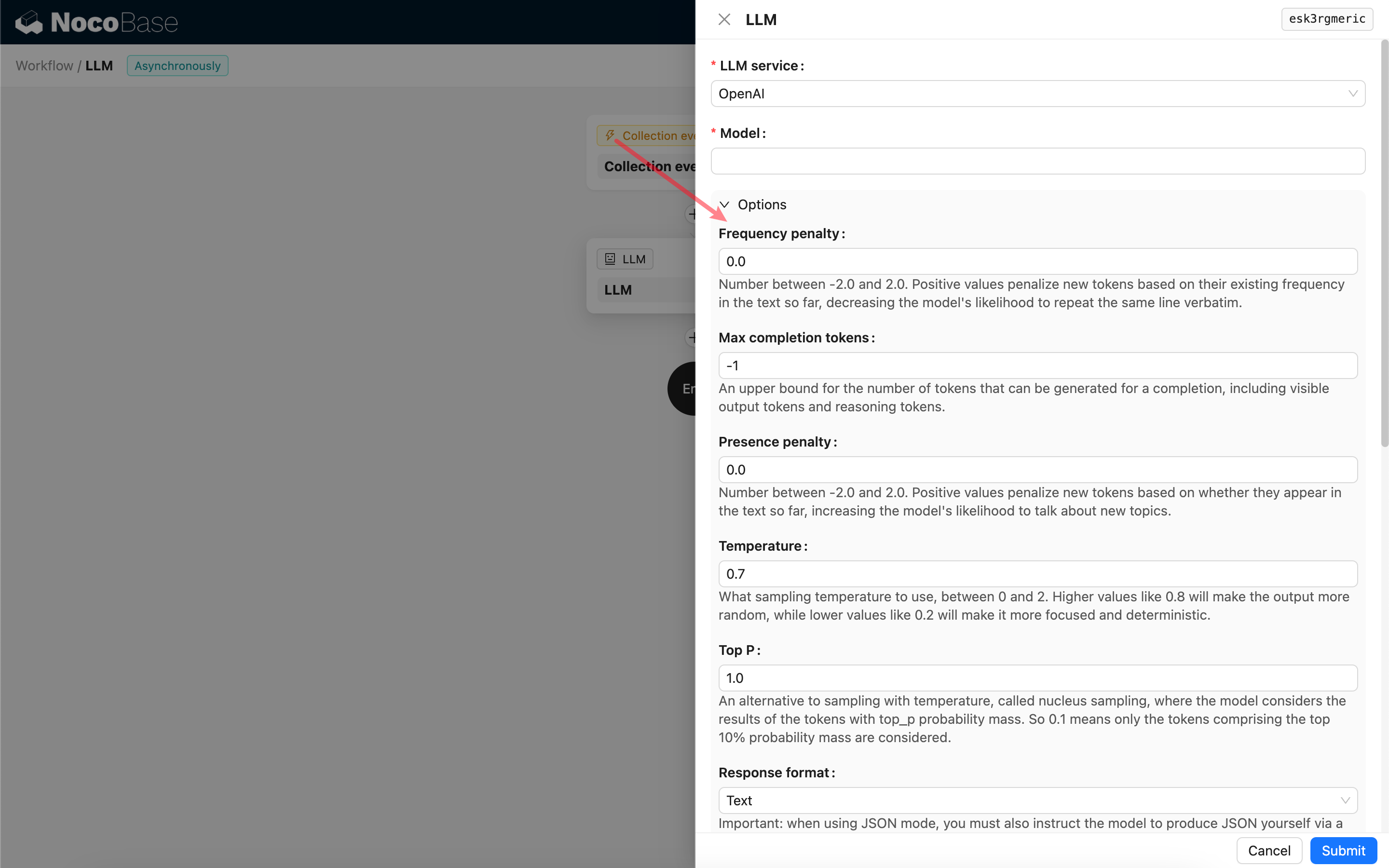

Налаштування параметрів виклику

Ви можете налаштувати параметри виклику моделі LLM за потреби.

Response format

Серед них варто звернути увагу на налаштування Response format. Цей параметр використовується для вказівки великій моделі формату вмісту відповіді, який може бути текстовим або JSON. Якщо обрано режим JSON, слід звернути увагу на таке:

- Відповідна модель LLM повинна підтримувати виклик у режимі JSON, водночас користувачеві потрібно чітко вказати LLM у Prompt відповідати у форматі JSON, наприклад: "Tell me a joke about cats, respond in JSON with `setup` and `punchline` keys". Інакше результату відповіді може не бути, і виникне помилка

400 status code (no body). - Результат відповіді — це рядок JSON. Користувачеві потрібно розпарсити його за допомогою можливостей інших вузлів робочого процесу, перш ніж використовувати його структурований вміст. Також можна скористатися функцією Структурований вивід.

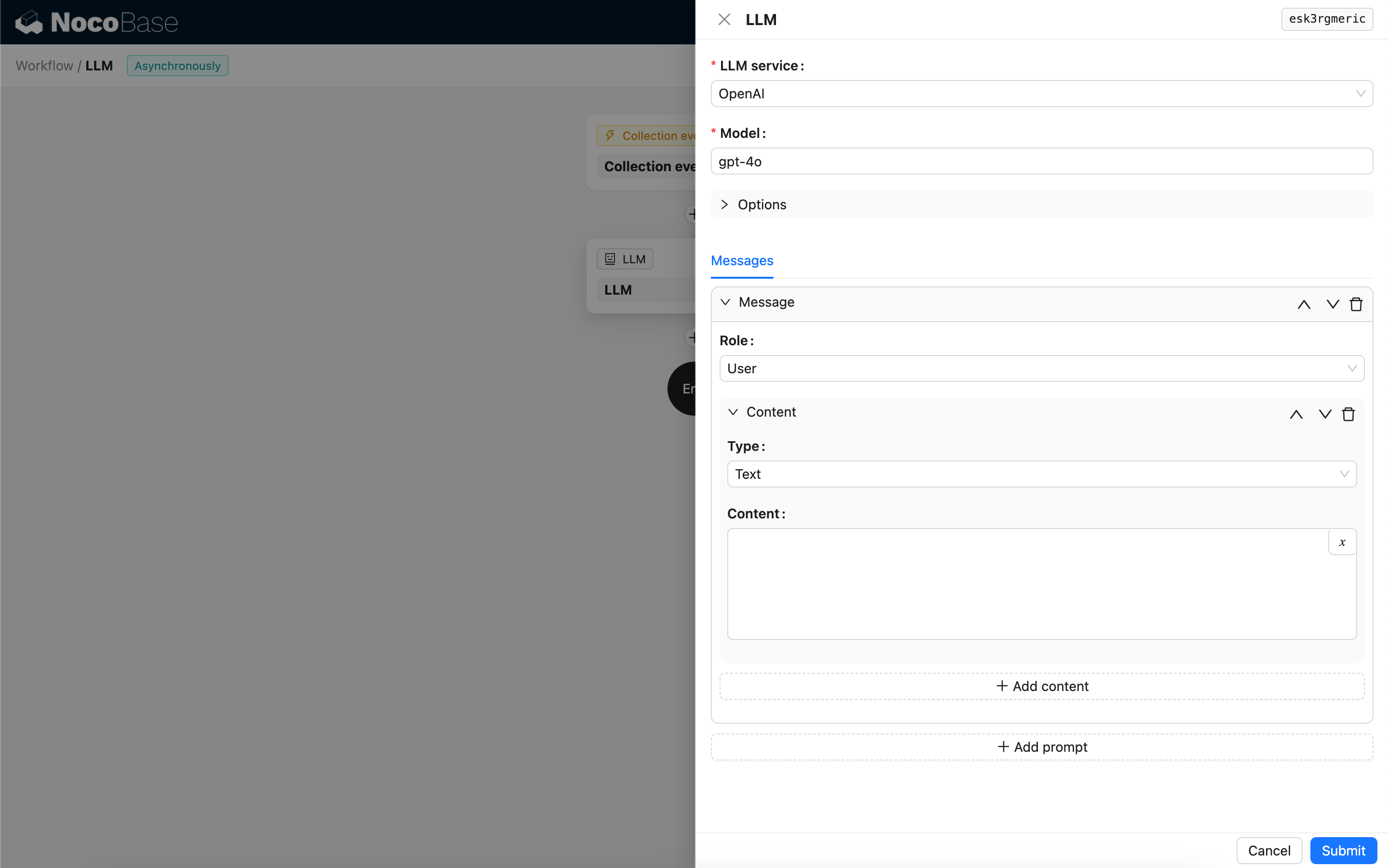

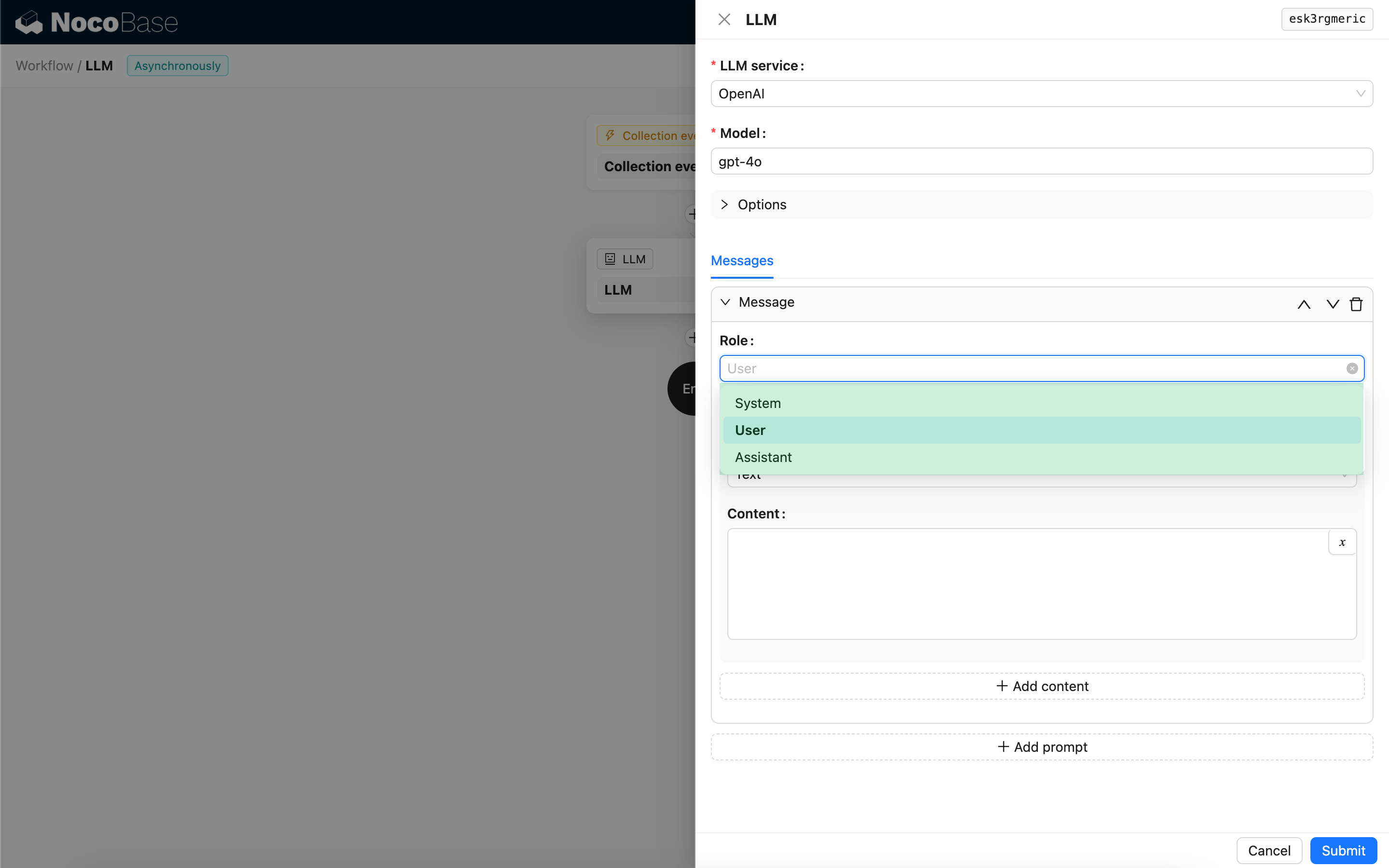

Повідомлення

Масив повідомлень, що надсилаються моделі LLM, може містити набір історичних повідомлень. Повідомлення підтримують три типи:

- System — зазвичай використовується для визначення ролі та поведінки моделі LLM у діалозі.

- User — вміст, введений користувачем.

- Assistant — вміст відповіді моделі.

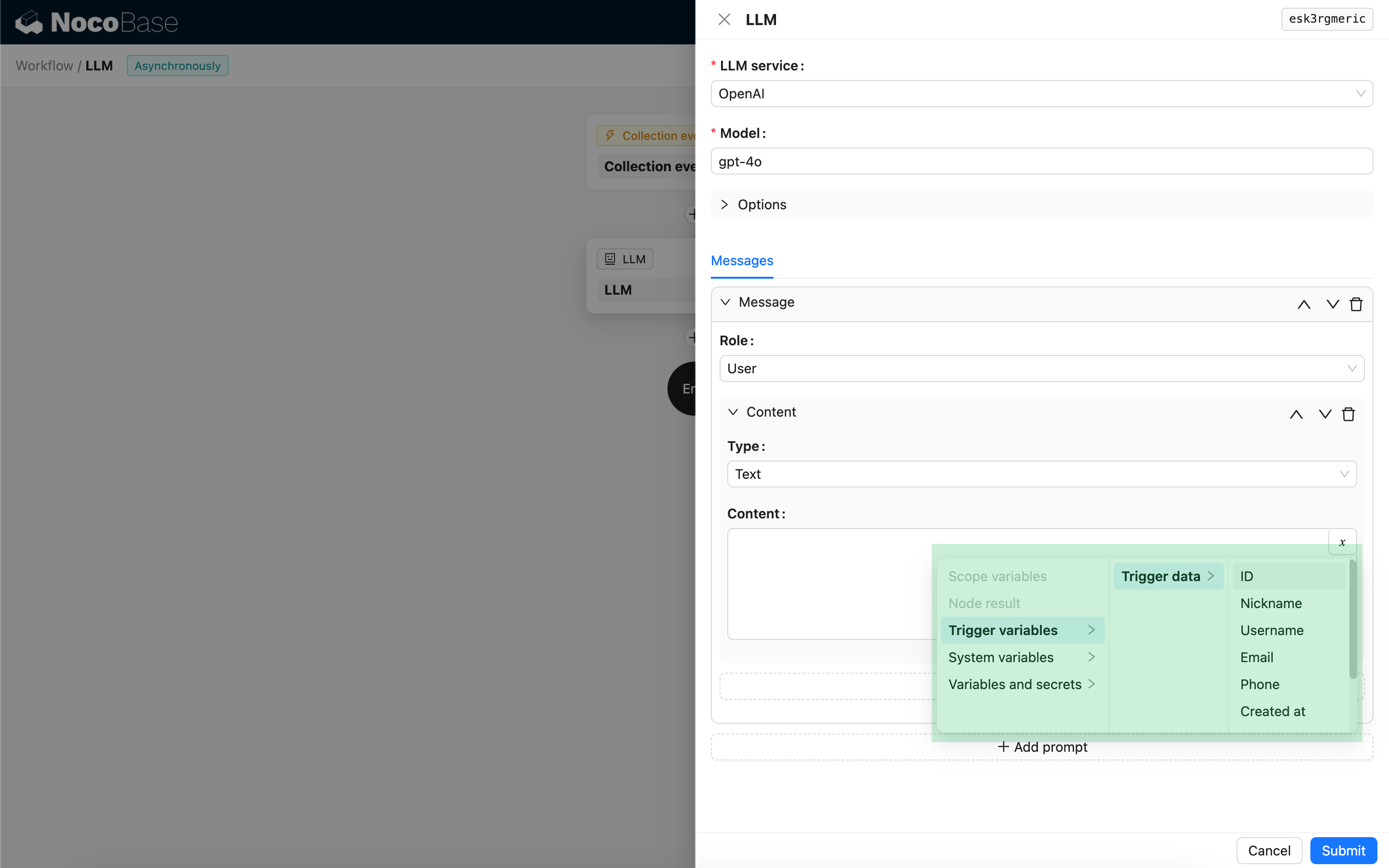

Для повідомлень користувача, за умови підтримки моделлю, ви можете додати кілька елементів вмісту в одну підказку, що відповідає параметру content. Якщо модель, яку ви використовуєте, підтримує параметр content лише у вигляді рядка (більшість моделей, що не підтримують мультимодальні діалоги, належать до цього типу), будь ласка, розділіть повідомлення на кілька підказок, кожна з яких містить лише один елемент вмісту. Таким чином вузол надішле вміст у вигляді рядка.

У вмісті повідомлення можна використовувати змінні для посилання на контекст робочого процесу.

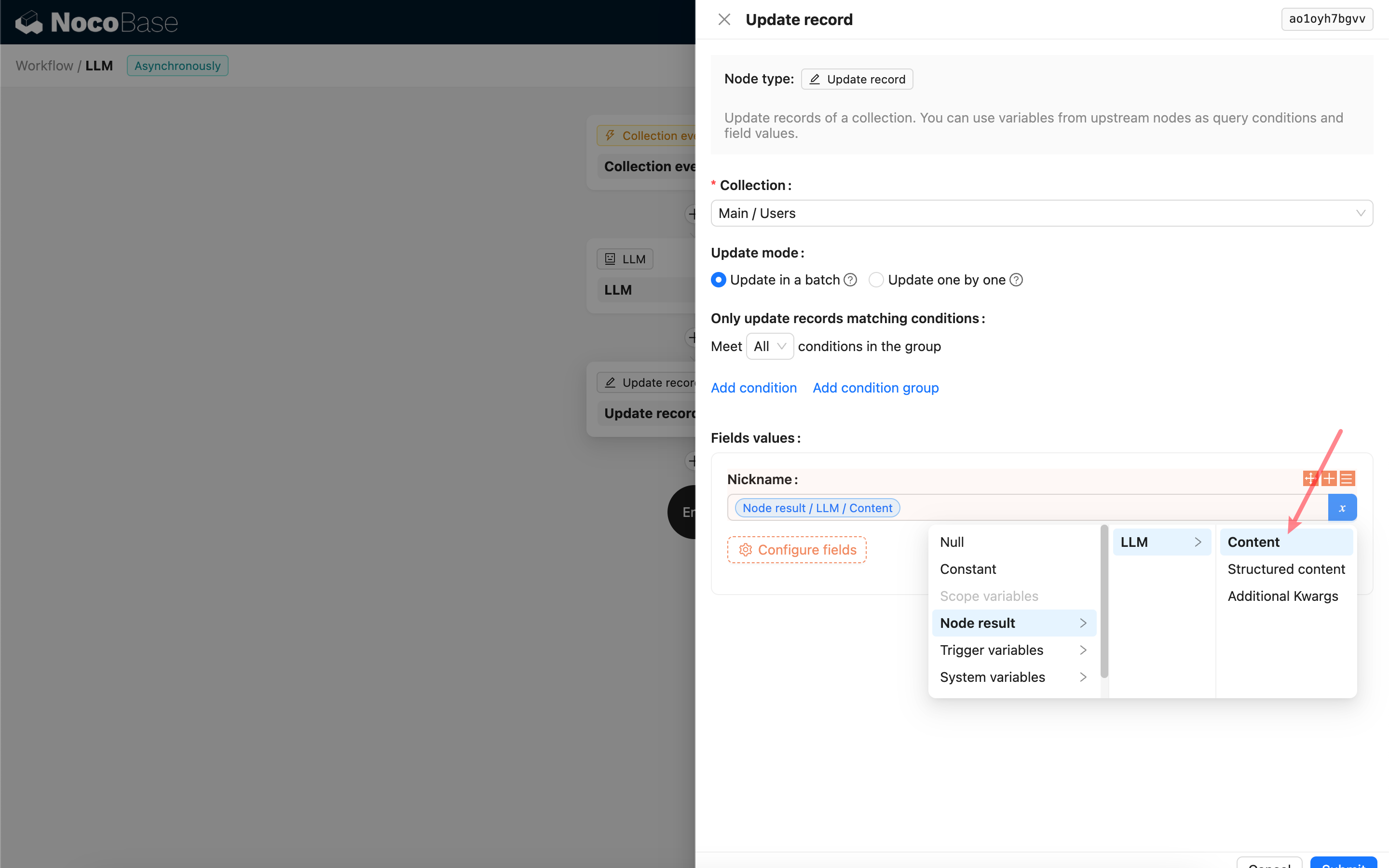

Використання вмісту відповіді вузла LLM

Ви можете використовувати вміст відповіді вузла LLM як змінну в інших вузлах.